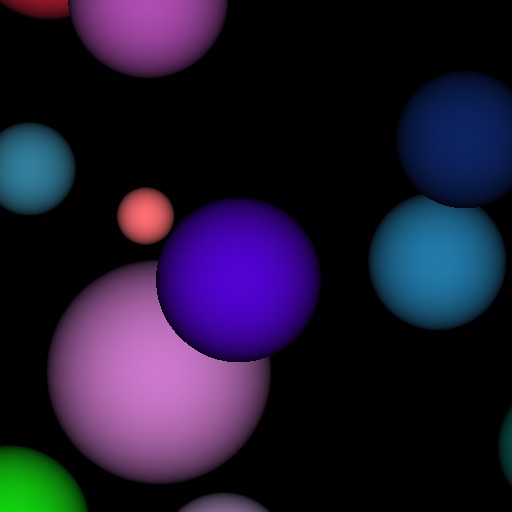

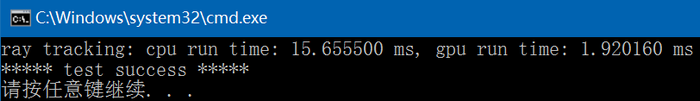

CUDA Samples: Ray Tracking

以下CUDA sample是分别用C++和CUDA实现的生成光线跟踪图像,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第六章,CUDA各实现包括了使用常量内存和不使用常量内存两种方法,各个文件内容如下:

funset.cpp:

#include "funset.hpp"

#include <random>

#include <iostream>

#include <vector>

#include <memory>

#include <string>

#include "common.hpp"

#include <opencv2/opencv.hpp>int test_ray_tracking()

{const int spheres{ 20 };std::unique_ptr<float[]> A(new float[spheres * 3]);std::unique_ptr<float[]> B(new float[spheres * 3]);std::unique_ptr<float[]> C(new float[spheres]);generator_random_number(A.get(), spheres * 3, 0.f, 1.f);generator_random_number(B.get(), spheres * 3, -400.f, 400.f);generator_random_number(C.get(), spheres, 20.f, 120.f);float elapsed_time1{ 0.f }, elapsed_time2{ 0.f }; // millisecondsconst int width{ 512 }, height = width;cv::Mat mat1(height, width, CV_8UC4), mat2(height, width, CV_8UC4);int ret = ray_tracking_cpu(A.get(), B.get(), C.get(), spheres, mat1.data, width, height, &elapsed_time1);if (ret != 0) PRINT_ERROR_INFO(ray_tracking_cpu);ret = ray_tracking_gpu(A.get(), B.get(), C.get(), spheres, mat2.data, width, height, &elapsed_time2);if (ret != 0) PRINT_ERROR_INFO(ray_tracking_gpu);for (int y = 0; y < height; ++y) {for (int x = 0; x < width; ++x) {cv::Vec4b val1 = mat1.at<cv::Vec4b>(y, x);cv::Vec4b val2 = mat2.at<cv::Vec4b>(y, x);for (int i = 0; i < 4; ++i) {if (val1[i] != val2[i]) {fprintf(stderr, "their values are different at (%d, %d), i: %d, val1: %d, val2: %d\n",x, y, i, val1[i], val2[i]);//return -1;}}}}const std::string save_image_name{ "E:/GitCode/CUDA_Test/ray_tracking.jpg" };cv::imwrite(save_image_name, mat2);fprintf(stderr, "ray tracking: cpu run time: %f ms, gpu run time: %f ms\n", elapsed_time1, elapsed_time2);return 0;

}#include "funset.hpp"

#include <chrono>

#include <memory>

#include "common.hpp"// 通过一个数据结构对球面建模

struct Sphere {float r, b, g;float radius;float x, y, z;float hit(float ox, float oy, float *n){float dx = ox - x;float dy = oy - y;if (dx*dx + dy*dy < radius*radius) {float dz = sqrtf(radius*radius - dx*dx - dy*dy);*n = dz / sqrtf(radius * radius);return dz + z;}return -INF;}

};int ray_tracking_cpu(const float* a, const float* b, const float* c, int sphere_num, unsigned char* ptr, int width, int height, float* elapsed_time)

{auto start = std::chrono::steady_clock::now();std::unique_ptr<Sphere[]> spheres(new Sphere[sphere_num]);for (int i = 0, t = 0; i < sphere_num; ++i, t+=3) {spheres[i].r = a[t];spheres[i].g = a[t+1];spheres[i].b = a[t+2];spheres[i].x = b[t];spheres[i].y = b[t+1];spheres[i].z = b[t+2];spheres[i].radius = c[i];}for (int y = 0; y < height; ++y) {for (int x = 0; x < width; ++x) {int offset = x + y * width;float ox{ (x - width / 2.f) };float oy{ (y - height / 2.f) };float r{ 0 }, g{ 0 }, b{ 0 };float maxz{ -INF };for (int i = 0; i < sphere_num; ++i) {float n;float t = spheres[i].hit(ox, oy, &n);if (t > maxz) {float fscale = n;r = spheres[i].r * fscale;g = spheres[i].g * fscale;b = spheres[i].b * fscale;maxz = t;}}ptr[offset * 4 + 0] = static_cast<unsigned char>(r * 255);ptr[offset * 4 + 1] = static_cast<unsigned char>(g * 255);ptr[offset * 4 + 2] = static_cast<unsigned char>(b * 255);ptr[offset * 4 + 3] = 255;}}auto end = std::chrono::steady_clock::now();auto duration = std::chrono::duration_cast<std::chrono::nanoseconds>(end - start);*elapsed_time = duration.count() * 1.0e-6;return 0;

}#include "funset.hpp"

#include <iostream>

#include <algorithm>

#include <memory>

#include <vector>

#include <cuda_runtime.h> // For the CUDA runtime routines (prefixed with "cuda_")

#include <device_launch_parameters.h>

#include "common.hpp"// 通过一个数据结构对球面建模

struct Sphere {float r, b, g;float radius;float x, y, z;/* __device__: 函数类型限定符,表明被修饰的函数在设备上执行,只能从设备上调用,但只能在其它__device__函数或者__global__函数中调用;__device__函数不支持递归;__device__函数的函数体内不能声明静态变量;__device__函数的参数数目是不可变化的;不能对__device__函数取指针 */__device__ float hit(float ox, float oy, float *n){float dx = ox - x;float dy = oy - y;if (dx*dx + dy*dy < radius*radius) {float dz = sqrtf(radius*radius - dx*dx - dy*dy);*n = dz / sqrtf(radius * radius);return dz + z;}return -INF;}

};// method2: 使用常量内存

/* __constant__: 变量类型限定符,或者与__device__限定符连用,这样声明的变量:存

在于常数存储器空间;与应用程序具有相同的生命周期;可以通过运行时库从主机端访问,

设备端的所有线程也可访问。__constant__变量默认为是静态存储。__constant__不能用

extern关键字声明为外部变量。__constant__变量只能在文件作用域中声明,不能再函数

体内声明。__constant__变量不能从device中赋值,只能从host中通过host运行时函数赋

值。__constant__将把变量的访问限制为只读。与从全局内存中读取数据相比,从常量内

存中读取相同的数据可以节约内存带宽。常量内存用于保存在核函数执行期间不会发生变

化的数据。

常量内存:用于保存在核函数执行期间不会发生变化的数据。NVIDIA硬件提供了64KB的常

量内存,并且对常量内存采取了不同于标准全局内存的处理方式。在某些情况中,用常量

内存来替换全局内存能有效地减少内存带宽。 在某些情况下,使用常量内存将提升应用程

序的性能 */

__constant__ Sphere dev_spheres[20]; // 常量内存, = sphere_num/* __global__: 函数类型限定符;在设备上运行;在主机端调用,计算能力3.2及以上可以在

设备端调用;声明的函数的返回值必须是void类型;对此类型函数的调用是异步的,即在

设备完全完成它的运行之前就返回了;对此类型函数的调用必须指定执行配置,即用于在

设备上执行函数时的grid和block的维度,以及相关的流(即插入<<< >>>运算符);

a kernel,表示此函数为内核函数(运行在GPU上的CUDA并行计算函数称为kernel(内核函

数),内核函数必须通过__global__函数类型限定符定义); */

__global__ static void ray_tracking(unsigned char* ptr_image, Sphere* ptr_sphere, int width, int height, int sphere_num)

{/* gridDim: 内置变量,用于描述线程网格的维度,对于所有线程块来说,这个变量是一个常数,用来保存线程格每一维的大小,即每个线程格中线程块的数量.一个grid最多只有二维,为dim3类型;blockDim: 内置变量,用于说明每个block的维度与尺寸.为dim3类型,包含了block在三个维度上的尺寸信息;对于所有线程块来说,这个变量是一个常数,保存的是线程块中每一维的线程数量;blockIdx: 内置变量,变量中包含的值就是当前执行设备代码的线程块的索引;用于说明当前thread所在的block在整个grid中的位置,blockIdx.x取值范围是[0,gridDim.x-1],blockIdx.y取值范围是[0, gridDim.y-1].为uint3类型,包含了一个block在grid中各个维度上的索引信息;threadIdx: 内置变量,变量中包含的值就是当前执行设备代码的线程索引;用于说明当前thread在block中的位置;如果线程是一维的可获取threadIdx.x,如果是二维的还可获取threadIdx.y,如果是三维的还可获取threadIdx.z;为uint3类型,包含了一个thread在block中各个维度的索引信息 */// map from threadIdx/BlockIdx to pixel positionint x = threadIdx.x + blockIdx.x * blockDim.x;int y = threadIdx.y + blockIdx.y * blockDim.y;int offset = x + y * blockDim.x * gridDim.x;float ox{ (x - width / 2.f) };float oy{ (y - height / 2.f) };float r{ 0 }, g{ 0 }, b{ 0 };float maxz{ -INF };for (int i = 0; i < sphere_num; ++i) {float n;float t = ptr_sphere[i].hit(ox, oy, &n);if (t > maxz) {float fscale = n;r = ptr_sphere[i].r * fscale;g = ptr_sphere[i].g * fscale;b = ptr_sphere[i].b * fscale;maxz = t;}}ptr_image[offset * 4 + 0] = static_cast<unsigned char>(r * 255);ptr_image[offset * 4 + 1] = static_cast<unsigned char>(g * 255);ptr_image[offset * 4 + 2] = static_cast<unsigned char>(b * 255);ptr_image[offset * 4 + 3] = 255;

}__global__ static void ray_tracking(unsigned char* ptr_image, int width, int height, int sphere_num)

{int x = threadIdx.x + blockIdx.x * blockDim.x;int y = threadIdx.y + blockIdx.y * blockDim.y;int offset = x + y * blockDim.x * gridDim.x;float ox{ (x - width / 2.f) };float oy{ (y - height / 2.f) };float r{ 0 }, g{ 0 }, b{ 0 };float maxz{ -INF };for (int i = 0; i < sphere_num; ++i) {float n;float t = dev_spheres[i].hit(ox, oy, &n);if (t > maxz) {float fscale = n;r = dev_spheres[i].r * fscale;g = dev_spheres[i].g * fscale;b = dev_spheres[i].b * fscale;maxz = t;}}ptr_image[offset * 4 + 0] = static_cast<unsigned char>(r * 255);ptr_image[offset * 4 + 1] = static_cast<unsigned char>(g * 255);ptr_image[offset * 4 + 2] = static_cast<unsigned char>(b * 255);ptr_image[offset * 4 + 3] = 255;

}int ray_tracking_gpu(const float* a, const float* b, const float* c, int sphere_num, unsigned char* ptr, int width, int height, float* elapsed_time)

{/* cudaEvent_t: CUDA event types,结构体类型, CUDA事件,用于测量GPU在某个任务上花费的时间,CUDA中的事件本质上是一个GPU时间戳,由于CUDA事件是在GPU上实现的,因此它们不适于对同时包含设备代码和主机代码的混合代码计时 */cudaEvent_t start, stop;// cudaEventCreate: 创建一个事件对象,异步启动cudaEventCreate(&start);cudaEventCreate(&stop);// cudaEventRecord: 记录一个事件,异步启动,start记录起始时间cudaEventRecord(start, 0);const size_t length{ width * height * 4 * sizeof(unsigned char) };unsigned char* dev_image{ nullptr };std::unique_ptr<Sphere[]> spheres(new Sphere[sphere_num]);for (int i = 0, t = 0; i < sphere_num; ++i, t += 3) {spheres[i].r = a[t];spheres[i].g = a[t + 1];spheres[i].b = a[t + 2];spheres[i].x = b[t];spheres[i].y = b[t + 1];spheres[i].z = b[t + 2];spheres[i].radius = c[i];}// cudaMalloc: 在设备端分配内存cudaMalloc(&dev_image, length);// method1: 没有使用常量内存//Sphere* dev_spheres{ nullptr };//cudaMalloc(&dev_spheres, sizeof(Sphere) * sphere_num);/* cudaMemcpy: 在主机端和设备端拷贝数据,此函数第四个参数仅能是下面之一:(1). cudaMemcpyHostToHost: 拷贝数据从主机端到主机端(2). cudaMemcpyHostToDevice: 拷贝数据从主机端到设备端(3). cudaMemcpyDeviceToHost: 拷贝数据从设备端到主机端(4). cudaMemcpyDeviceToDevice: 拷贝数据从设备端到设备端(5). cudaMemcpyDefault: 从指针值自动推断拷贝数据方向,需要支持统一虚拟寻址(CUDA6.0及以上版本)cudaMemcpy函数对于主机是同步的 *///cudaMemcpy(dev_spheres, spheres.get(), sizeof(Sphere) * sphere_num, cudaMemcpyHostToDevice);// method2: 使用常量内存/* cudaMemcpyToSymbol: cudaMemcpyToSymbol和cudaMemcpy参数为cudaMemcpyHostToDevice时的唯一差异在于cudaMemcpyToSymbol会复制到常量内存,而cudaMemcpy会复制到全局内存*/cudaMemcpyToSymbol(dev_spheres, spheres.get(), sizeof(Sphere)* sphere_num);const int threads_block{ 16 };dim3 blocks(width / threads_block, height / threads_block);dim3 threads(threads_block, threads_block);/* <<< >>>: 为CUDA引入的运算符,指定线程网格和线程块维度等,传递执行参数给CUDA编译器和运行时系统,用于说明内核函数中的线程数量,以及线程是如何组织的;尖括号中这些参数并不是传递给设备代码的参数,而是告诉运行时如何启动设备代码,传递给设备代码本身的参数是放在圆括号中传递的,就像标准的函数调用一样;不同计算能力的设备对线程的总数和组织方式有不同的约束;必须先为kernel中用到的数组或变量分配好足够的空间,再调用kernel函数,否则在GPU计算时会发生错误,例如越界等;使用运行时API时,需要在调用的内核函数名与参数列表直接以<<<Dg,Db,Ns,S>>>的形式设置执行配置,其中:Dg是一个dim3型变量,用于设置grid的维度和各个维度上的尺寸.设置好Dg后,grid中将有Dg.x*Dg.y个block,Dg.z必须为1;Db是一个dim3型变量,用于设置block的维度和各个维度上的尺寸.设置好Db后,每个block中将有Db.x*Db.y*Db.z个thread;Ns是一个size_t型变量,指定各块为此调用动态分配的共享存储器大小,这些动态分配的存储器可供声明为外部数组(extern __shared__)的其他任何变量使用;Ns是一个可选参数,默认值为0;S为cudaStream_t类型,用于设置与内核函数关联的流.S是一个可选参数,默认值0. *///ray_tracking << <blocks, threads >> >(dev_image, dev_spheres, width, height, sphere_num); // method1, 不使用常量内存ray_tracking << <blocks, threads >> >(dev_image, width, height, sphere_num); // method2, 使用常量内存cudaMemcpy(ptr, dev_image, length, cudaMemcpyDeviceToHost);// cudaFree: 释放设备上由cudaMalloc函数分配的内存cudaFree(dev_image);//cudaFree(dev_spheres); // 使用method1时需要释放, 如果使用常量内存即method2则不需要释放// cudaEventRecord: 记录一个事件,异步启动,stop记录结束时间cudaEventRecord(stop, 0);// cudaEventSynchronize: 事件同步,等待一个事件完成,异步启动cudaEventSynchronize(stop);// cudaEventElapseTime: 计算两个事件之间经历的时间,单位为毫秒,异步启动cudaEventElapsedTime(elapsed_time, start, stop);// cudaEventDestroy: 销毁事件对象,异步启动cudaEventDestroy(start);cudaEventDestroy(stop);return 0;

}

相关文章:

从产品的适用性以及费用方面考虑

物联宇手持终端在对比性价比高低应该从产品的适用性以及费用方面考虑。不过在选择时不一定要整机,可以按实际需求让厂商定做和行业需要功能的手持机,这样有针对性的定制更能体现整体的性价效率。转载于:https://blog.51cto.com/14222294/2386642

杨学海:跨境电商新通道-进口保税直邮模式解析

为什么80%的码农都做不了架构师?>>> 杨学海:跨境电商新通道-进口保税直邮模式解析 广州威云供应链管理公司总经理杨学海在第九届中国中小企业电子商务大会上表示,其品牌海外通要为跨境电子商务提供一个更加快速、便捷、低成本&am…

CUDA Samples: heat conduction(模拟热传导)

以下CUDA sample是分别用C和CUDA实现的模拟热传导生成的图像,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第七章,各个文件内容如下:funset.cpp:#include "funset.hpp" #include <…

2020应届生:今年秋招也太太太太太难了吧!

讲个简短的鬼故事:2020秋招已经过去一大半了!回顾9月,你可能以为秋招还有很多机会,还有大把时间准备。然而各大名企的实际进度却不等人。阿里巴巴9月12日网申截止;腾讯9月15日网申截止;宝洁9月20日关闭网申…

PDF文字怎么编辑,PDF文档编辑方法

有时候遇到PDF文件不是自己制作的或者是制作的有点匆忙,会有文字遗漏或者打错的时候,我们使用就会有点麻烦就需要把文件中的文字进行编辑修改,那么具体怎么做呢?小伙伴们都挺好奇吧,今天就来跟大家分享一下。操作软件&…

浏览器是怎样工作的:渲染引擎,HTML解析

2019独角兽企业重金招聘Python工程师标准>>> 渲染引擎 渲染引擎的职责是……渲染,也就是把请求的内容显示到浏览器屏幕上。 默认情况下渲染引擎可以显示HTML,XML文档以及图片。 通过插件(浏览器扩展)它可以显示其它类型…

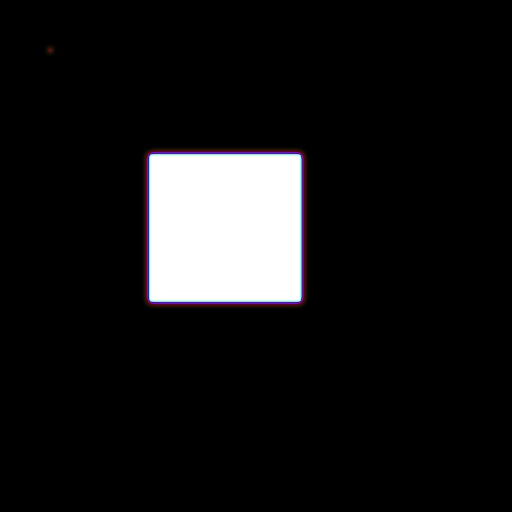

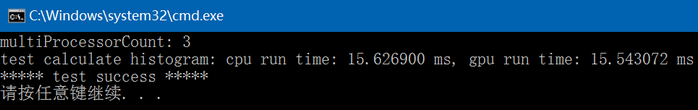

CUDA Samples: Calculate Histogram(atomicAdd)

以下CUDA sample是分别用C和CUDA实现的计算一维直方图,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第九章,各个文件内容如下:funset.cpp:#include "funset.hpp" #include <rando…

glusterfs基本操作

基本操作 集群节点 扩展集群 1,必须做hosts域名解析其实通过IP地址也能做集群,但是不建议这种方式. 192.168.1.210 glusterfs04 2, 添加节点到集群中,在当前所有集群节点中都需要执行 gluster peer probe glusterfs04 3,查看对等状态 gluster peer status 查看集群节点信息 gl…

100多次竞赛后,他研发了一个几乎可以解决所有机器学习问题的框架

(图片由AI科技大本营付费下载自视觉中国)作者 | XI YANG来源 | 知乎(机器学习之路)一个叫 Abhishek Thakur 的数据科学家,在他的 Linkedin 发表了一篇文章 Approaching (Almost) Any Machine Learning Problem…

mysql中char与varchar的区别分析(补充一句,int和integer没区别)

转自:http://www.jb51.net/article/23575.htm 在mysql教程中char与varchar的区别呢,都是用来存储字符串的,只是他们的保存方式不一样罢了,char有固定的长度,而varchar属于可变长的字符类型。har与varchar的区别 &#…

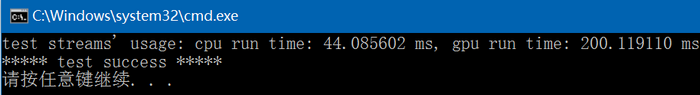

CUDA Samples: Streams' usage

以下CUDA sample是分别用C和CUDA实现的流的使用code,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第十章,各个文件内容如下:funset.cpp:#include "funset.hpp" #include <random&…

你的神经网络不起作用的37个理由

(图片由AI科技大本营付费下载自视觉中国)作者 | Slav Ivanov译者 | 吴金笛校对 | 丁楠雅、林亦霖编辑 | 王菁来源 | 数据派THU(ID:DatapiTHU)【导语】本文列举了在搭建神经网络过程中的37个易错点,并给出了…

菜鸟Vue学习笔记(三)

菜鸟Vue学习笔记(三)本周使用了Vue来操作表单,接下来说下Vue中双向绑定表单元素的用法。Vue中双向绑定是使用的v-model,所谓的双向绑定即改变变量的值,表单元素的值也会改变,同样的,改变表单元素…

Python中的注释(转)

一、单行注释单行注释以#开头,例如:print 6 #输出6二、多行注释(Python的注释只有针对于单行的注释(用#),这是一种变通的方法)多行注释用三引号将注释括起来,例如:多行注释多行注释三…

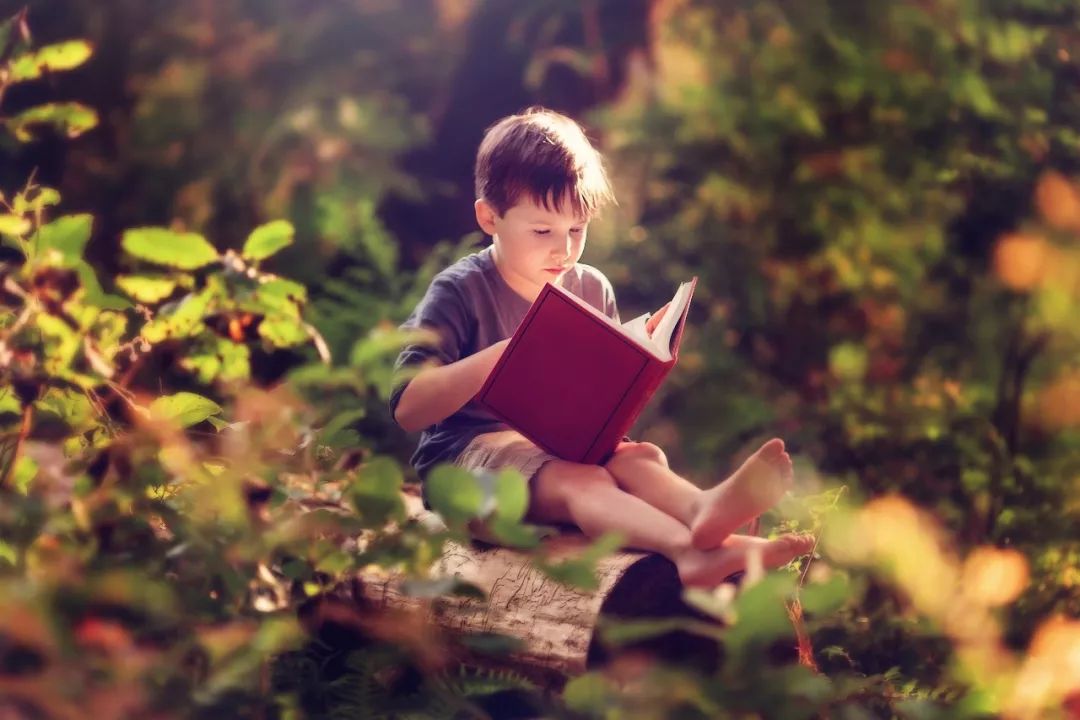

CUDA Samples: dot product(使用零拷贝内存)

以下CUDA sample是分别用C和CUDA实现的点积运算code,CUDA包括普通实现和采用零拷贝内存实现两种,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第十一章,各个文件内容如下:funset.cp…

一文读懂线性回归、岭回归和Lasso回归

(图片由AI科技大本营付费下载自视觉中国)作者 | 文杰编辑 | yuquanle本文介绍线性回归模型,从梯度下降和最小二乘的角度来求解线性回归问题,以概率的方式解释了线性回归为什么采用平方损失,然后介绍了线性回归中常用的…

tf.matmul / tf.multiply

import tensorflow as tfimport numpy as np 1.tf.placeholder placeholder()函数是在神经网络构建graph的时候在模型中的占位,此时并没有把要输入的数据传入模型,它只会分配必要的内存。 等建立session,在会话中,运行模型的时候通…

Java 匿名类也能使用构造函数

为什么80%的码农都做不了架构师?>>> 匿名类虽然没有名字,但可以有一个初始化块来充当构造函数。 public enum Ops {ADD, SUB} public class Calculator { private int i, j, result; public Calculator() {} public Calculator(int _i, …

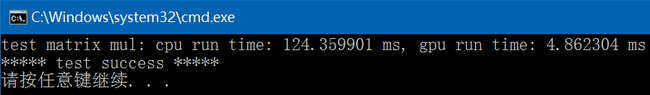

CUDA Samples: matrix multiplication(C = A * B)

以下CUDA sample是分别用C和CUDA实现的两矩阵相乘运算code即C A*B,CUDA中包含了两种核函数的实现方法,第一种方法来自于CUDA Samples\v8.0\0_Simple\matrixMul,第二种采用普通的方法实现,第一种方法较快,但有些复杂&am…

业界首个实时多目标跟踪系统开源

(图片由AI科技大本营付费下载自视觉中国)作者 | CV君来源 | 我爱计算机视觉(ID:aicvml)相对业界研究比较多的单目标跟踪,多目标跟踪(Multi-Object Tracking,MOT)系统在实…

python基础 练习题

【练习题1】实现一个整数加法计算器如 content input(">>> ") # 59 , 64 count0 while 1:contentinput(>>>)s1 content.split()print(s1)count 0for i in s1:count int(i)print(count) 【练习题2】请编写1 - 100 所有数的和 sum0 for i in r…

[再寄小读者之数学篇](2014-04-18 from 352558840@qq.com [南开大学 2014 年高等代数考研试题]二次型的零点)...

(2014-04-18 from 352558840qq.com [南开大学 2014 年高等代数考研试题]) 设 ${\bf A}$ 为实对称矩阵, 存在线性无关的向量 ${\bf x}_1,{\bf x}_2$, 使得 ${\bf x}_1^T{\bf A}{\bf x}_1>0$, ${\bf x}_2^T{\bf A}{\bf x}_2<0$. 证明: 存在线性无关的向量 ${\bf x}_3,{\bf …

从0到1详解推荐系统中的嵌入方法,原理、算法到应用都讲明白了

(图片由AI科技大本营付费下载自视觉中国)作者丨gongyouliu编辑丨lily来源 | 大数据与人工智能(ID:)前言作者曾在这篇文章中提到,矩阵分解算法是一类嵌入方法,通过将用户行为矩阵分解为用户特征矩…

iOS-Swift中的递增(++)和递减(--)被取消的原因-官方答复

众所周知,在很多编程语言中,对一个变量递增1用,递减1用--,在Swift3之前也是可以这么用的,但之后被取消了。 所以在目前Swift5的版本中,只能用1和-1来进行递增和递减了 如果坚持用或--将会提示以下错误&…

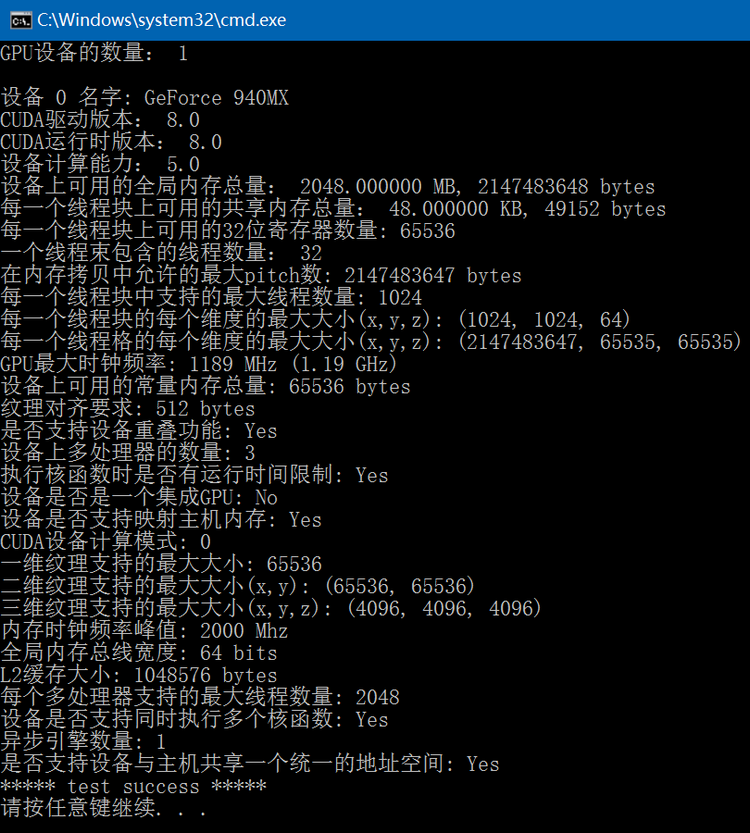

CUDA Samples: 获取设备属性信息

通过调用CUDA的cudaGetDeviceProperties函数可以获得指定设备的相关信息,此函数会根据GPU显卡和CUDA版本的不同得到的结果也有所差异,下面code列出了经常用到的设备信息:#include "funset.hpp" #include <iostream> #include…

apache代理模块proxy使用

1、安装proxy模块[rootlocalhost modules]# cd /usr/local/src/httpd-2.2.16 [rootlocalhost httpd-2.2.16]# cd modules [rootlocalhost modules]# ls aaa config5.m4 debug filters ldap Makefile.in NWGNUmakefile ssl arch database echo …

CUDA Samples: image normalize(mean/standard deviation)

以下CUDA sample是分别用C和CUDA实现的通过均值和标准差对图像进行类似归一化的操作,并对其中使用到的CUDA函数进行了解说,各个文件内容如下:关于均值和标准差的计算公式可参考: http://blog.csdn.net/fengbingchun/article/detai…

中文预训练ALBERT模型来了:小模型登顶GLUE,Base版模型小10倍、速度快1倍

(图片由AI科技大本营付费下载自视觉中国)作者 | 徐亮(实在智能算法专家) 来源 | AINLP(ID:nlpjob)谷歌ALBERT论文刚刚出炉一周,中文预训练ALBERT模型来了,感兴趣的同学可以直接尝鲜试…

树莓派安装go

简介 大学的时候在使用openfalcon的时候讲过这个东西,但是那时候是介绍open-falcon的,所以感觉不是很具体,所以今天在安装frp的时候也碰到了这个问题,我就具体的说下 安装go1.4 编译最新版本的go的时候一定要先编译安装go1.4&…

设计模式中的原则

设计模式(详情click)这个术语是由Erich Gamma等人在1990年代从建筑设计领域引入到计算机科学的。它是对软件设计中普遍存在(反复出现)的各种问题,所提出的解决方案。 设计模式并不直接用来完成代码的编写,而是描述在各种不同情况下…