CUDA Samples: Dot Product

以下CUDA sample是分别用C++和CUDA实现的两个非常大的向量实现点积操作,并对其中使用到的CUDA函数进行了解说,各个文件内容如下:

common.hpp:

#ifndef FBC_CUDA_TEST_COMMON_HPP_

#define FBC_CUDA_TEST_COMMON_HPP_#include<random>template< typename T >

static inline int check_Cuda(T result, const char * const func, const char * const file, const int line)

{if (result) {fprintf(stderr, "Error CUDA: at %s: %d, error code=%d, func: %s\n", file, line, static_cast<unsigned int>(result), func);cudaDeviceReset(); // Make sure we call CUDA Device Reset before exitingreturn -1;}

}template< typename T >

static inline int check(T result, const char * const func, const char * const file, const int line)

{if (result) {fprintf(stderr, "Error: at %s: %d, error code=%d, func: %s\n", file, line, static_cast<unsigned int>(result), func);return -1;}

}#define checkCudaErrors(val) check_Cuda((val), __FUNCTION__, __FILE__, __LINE__)

#define checkErrors(val) check((val), __FUNCTION__, __FILE__, __LINE__)#define CHECK(x) { \if (x) {} \else { fprintf(stderr, "Check Failed: %s, file: %s, line: %d\n", #x, __FILE__, __LINE__); return -1; } \

}#define PRINT_ERROR_INFO(info) { \fprintf(stderr, "Error: %s, file: %s, func: %s, line: %d\n", #info, __FILE__, __FUNCTION__, __LINE__); \return -1; }#define EPS 1.0e-4 // ε(Epsilon),非常小的数static inline void generator_random_number(float* data, int length, float a = 0.f, float b = 1.f)

{std::random_device rd; std::mt19937 generator(rd()); // 每次产生不固定的不同的值//std::default_random_engine generator; // 每次产生固定的不同的值std::uniform_real_distribution<float> distribution(a, b);for (int i = 0; i < length; ++i) {data[i] = distribution(generator);}

}#endif // FBC_CUDA_TEST_COMMON_HPP_#include "funset.hpp"

#include <random>

#include <iostream>

#include <vector>

#include <memory>

#include "common.hpp"int test_dot_product()

{const int length{ 10000000 };std::unique_ptr<float[]> A(new float[length]);std::unique_ptr<float[]> B(new float[length]);generator_random_number(A.get(), length, -10.f, 10.f);generator_random_number(B.get(), length, -10.f, 10.f);float elapsed_time1{ 0.f }, elapsed_time2{ 0.f }; // millisecondsfloat value1{ 0.f }, value2{ 0.f };int ret = dot_product_cpu(A.get(), B.get(), &value1, length, &elapsed_time1);if (ret != 0) PRINT_ERROR_INFO(long_vector_add_cpu);ret = dot_product_gpu(A.get(), B.get(), &value2, length, &elapsed_time2);if (ret != 0) PRINT_ERROR_INFO(matrix_mul_gpu);if (fabs(value1 - value2) > EPS) {fprintf(stderr, "Result verification failed value1: %f, value2: %f\n", value1, value2);}fprintf(stderr, "cpu run time: %f ms, gpu run time: %f ms\n", elapsed_time1, elapsed_time2);return 0;

}#include "funset.hpp"

#include <chrono>int dot_product_cpu(const float* A, const float* B, float* value, int elements_num, float* elapsed_time)

{auto start = std::chrono::steady_clock::now();*value = 0.f;for (int i = 0; i < elements_num; ++i) {(*value) += A[i] * B[i];}auto end = std::chrono::steady_clock::now();auto duration = std::chrono::duration_cast<std::chrono::nanoseconds>(end - start);*elapsed_time = duration.count() * 1.0e-6;return 0;

}#include "funset.hpp"

#include <iostream>

#include <algorithm>

#include <memory>

#include <cuda_runtime.h> // For the CUDA runtime routines (prefixed with "cuda_")

#include <device_launch_parameters.h>

#include "common.hpp"/* __global__: 函数类型限定符;在设备上运行;在主机端调用,计算能力3.2及以上可以在

设备端调用;声明的函数的返回值必须是void类型;对此类型函数的调用是异步的,即在

设备完全完成它的运行之前就返回了;对此类型函数的调用必须指定执行配置,即用于在

设备上执行函数时的grid和block的维度,以及相关的流(即插入<<< >>>运算符);

a kernel,表示此函数为内核函数(运行在GPU上的CUDA并行计算函数称为kernel(内核函

数),内核函数必须通过__global__函数类型限定符定义);*/

__global__ static void dot_product(const float* A, const float* B, float* partial_C, int elements_num)

{/* __shared__: 变量类型限定符;使用__shared__限定符,或者与__device__限定符连用,此时声明的变量位于block中的共享存储器空间中,与block具有相同的生命周期,仅可通过block内的所有线程访问;__shared__和__constant__变量默认为是静态存储;在__shared__前可以加extern关键字,但表示的是变量大小由执行参数确定;__shared__变量在声明时不能初始化;可以将CUDA C的关键字__shared__添加到变量声明中,这将使这个变量驻留在共享内存中;CUDA C编译器对共享内存中的变量与普通变量将分别采取不同的处理方式 */__shared__ float cache[256]; // == threadsPerBlock/* gridDim: 内置变量,用于描述线程网格的维度,对于所有线程块来说,这个变量是一个常数,用来保存线程格每一维的大小,即每个线程格中线程块的数量.一个grid最多只有二维,为dim3类型;blockDim: 内置变量,用于说明每个block的维度与尺寸.为dim3类型,包含了block在三个维度上的尺寸信息;对于所有线程块来说,这个变量是一个常数,保存的是线程块中每一维的线程数量;blockIdx: 内置变量,变量中包含的值就是当前执行设备代码的线程块的索引;用于说明当前thread所在的block在整个grid中的位置,blockIdx.x取值范围是[0,gridDim.x-1],blockIdx.y取值范围是[0, gridDim.y-1].为uint3类型,包含了一个block在grid中各个维度上的索引信息;threadIdx: 内置变量,变量中包含的值就是当前执行设备代码的线程索引;用于说明当前thread在block中的位置;如果线程是一维的可获取threadIdx.x,如果是二维的还可获取threadIdx.y,如果是三维的还可获取threadIdx.z;为uint3类型,包含了一个thread在block中各个维度的索引信息 */int tid = threadIdx.x + blockIdx.x * blockDim.x;int cacheIndex = threadIdx.x;float tmp{ 0.f };while (tid < elements_num) {tmp += A[tid] * B[tid];tid += blockDim.x * gridDim.x;}// 设置cache中相应位置上的值// 共享内存缓存中的偏移就等于线程索引;线程块索引与这个偏移无关,因为每// 个线程块都拥有该共享内存的私有副本cache[cacheIndex] = tmp;/* __syncthreads: 对线程块中的线程进行同步;CUDA架构将确保,除非线程块中的每个线程都执行了__syncthreads(),否则没有任何线程能执行__syncthreads()之后的指令;在同一个block中的线程通过共享存储器(shared memory)交换数据,并通过栅栏同步(可以在kernel函数中需要同步的位置调用__syncthreads()函数)保证线程间能够正确地共享数据;使用clock()函数计时,在内核函数中要测量的一段代码的开始和结束的位置分别调用一次clock()函数,并将结果记录下来。由于调用__syncthreads()函数后,一个block中的所有thread需要的时间是相同的,因此只需要记录每个block执行需要的时间就行了,而不需要记录每个thread的时间 */__syncthreads();// 对于规约运算来说,以下code要求threadPerBlock必须是2的指数int i = blockDim.x / 2;while (i != 0) {if (cacheIndex < i)cache[cacheIndex] += cache[cacheIndex + i];// 在循环迭代中更新了共享内存变量cache,并且在循环的下一次迭代开始之前,// 需要确保当前迭代中所有线程的更新操作都已经完成__syncthreads();i /= 2;}// 只有cacheIndex == 0的线程执行这个保存操作,这是因为只有一个值写入到// 全局内存,因此只需要一个线程来执行这个操作,当然你也可以选择任何一个// 线程将cache[0]写入到全局内存if (cacheIndex == 0)partial_C[blockIdx.x] = cache[0];

}int dot_product_gpu(const float* A, const float* B, float* value, int elements_num, float* elapsed_time)

{/* cudaEvent_t: CUDA event types,结构体类型, CUDA事件,用于测量GPU在某个任务上花费的时间,CUDA中的事件本质上是一个GPU时间戳,由于CUDA事件是在GPU上实现的,因此它们不适于对同时包含设备代码和主机代码的混合代码计时*/cudaEvent_t start, stop;// cudaEventCreate: 创建一个事件对象,异步启动cudaEventCreate(&start);cudaEventCreate(&stop);// cudaEventRecord: 记录一个事件,异步启动,start记录起始时间cudaEventRecord(start, 0);size_t lengthA{ elements_num * sizeof(float) }, lengthB{ elements_num * sizeof(float) };float *d_A{ nullptr }, *d_B{ nullptr }, *d_partial_C{ nullptr };// cudaMalloc: 在设备端分配内存cudaMalloc(&d_A, lengthA);cudaMalloc(&d_B, lengthB);/* cudaMemcpy: 在主机端和设备端拷贝数据,此函数第四个参数仅能是下面之一:(1). cudaMemcpyHostToHost: 拷贝数据从主机端到主机端(2). cudaMemcpyHostToDevice: 拷贝数据从主机端到设备端(3). cudaMemcpyDeviceToHost: 拷贝数据从设备端到主机端(4). cudaMemcpyDeviceToDevice: 拷贝数据从设备端到设备端(5). cudaMemcpyDefault: 从指针值自动推断拷贝数据方向,需要支持统一虚拟寻址(CUDA6.0及以上版本)cudaMemcpy函数对于主机是同步的 */cudaMemcpy(d_A, A, lengthA, cudaMemcpyHostToDevice);cudaMemcpy(d_B, B, lengthB, cudaMemcpyHostToDevice);const int threadsPerBlock{ 256 };const int blocksPerGrid = std::min(64, (elements_num + threadsPerBlock - 1) / threadsPerBlock);size_t lengthC{ blocksPerGrid * sizeof(float) };cudaMalloc(&d_partial_C, lengthC);/* <<< >>>: 为CUDA引入的运算符,指定线程网格和线程块维度等,传递执行参数给CUDA编译器和运行时系统,用于说明内核函数中的线程数量,以及线程是如何组织的;尖括号中这些参数并不是传递给设备代码的参数,而是告诉运行时如何启动设备代码,传递给设备代码本身的参数是放在圆括号中传递的,就像标准的函数调用一样;不同计算能力的设备对线程的总数和组织方式有不同的约束;必须先为kernel中用到的数组或变量分配好足够的空间,再调用kernel函数,否则在GPU计算时会发生错误,例如越界等;使用运行时API时,需要在调用的内核函数名与参数列表直接以<<<Dg,Db,Ns,S>>>的形式设置执行配置,其中:Dg是一个dim3型变量,用于设置grid的维度和各个维度上的尺寸.设置好Dg后,grid中将有Dg.x*Dg.y个block,Dg.z必须为1;Db是一个dim3型变量,用于设置block的维度和各个维度上的尺寸.设置好Db后,每个block中将有Db.x*Db.y*Db.z个thread;Ns是一个size_t型变量,指定各块为此调用动态分配的共享存储器大小,这些动态分配的存储器可供声明为外部数组(extern __shared__)的其他任何变量使用;Ns是一个可选参数,默认值为0;S为cudaStream_t类型,用于设置与内核函数关联的流.S是一个可选参数,默认值0. */dot_product << < blocksPerGrid, threadsPerBlock >> >(d_A, d_B, d_partial_C, elements_num);/* cudaDeviceSynchronize: kernel的启动是异步的, 为了定位它是否出错, 一般需要加上cudaDeviceSynchronize函数进行同步; 将会一直处于阻塞状态,直到前面所有请求的任务已经被全部执行完毕,如果前面执行的某个任务失败,将会返回一个错误;当程序中有多个流,并且流之间在某一点需要通信时,那就必须在这一点处加上同步的语句,即cudaDeviceSynchronize;异步启动reference: https://stackoverflow.com/questions/11888772/when-to-call-cudadevicesynchronize *///cudaDeviceSynchronize();std::unique_ptr<float[]> partial_C(new float[blocksPerGrid]);cudaMemcpy(partial_C.get(), d_partial_C, lengthC, cudaMemcpyDeviceToHost);*value = 0.f;for (int i = 0; i < blocksPerGrid; ++i) {(*value) += partial_C[i];}// cudaFree: 释放设备上由cudaMalloc函数分配的内存cudaFree(d_A);cudaFree(d_B);cudaFree(d_partial_C);// cudaEventRecord: 记录一个事件,异步启动,stop记录结束时间cudaEventRecord(stop, 0);// cudaEventSynchronize: 事件同步,等待一个事件完成,异步启动cudaEventSynchronize(stop);// cudaEventElapseTime: 计算两个事件之间经历的时间,单位为毫秒,异步启动cudaEventElapsedTime(elapsed_time, start, stop);// cudaEventDestroy: 销毁事件对象,异步启动cudaEventDestroy(start);cudaEventDestroy(stop);return 0;

}相关文章:

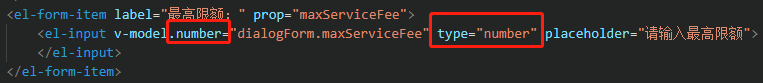

element ui只输入数字校验

注意:圈起来的两个地方,刚开始忘记写typenumber了,导致可以输入‘123abc’这样的,之后加上了就OK了 转载于:https://www.cnblogs.com/samsara-yx/p/10774270.html

对DeDecms之index.php页面的补充

2019独角兽企业重金招聘Python工程师标准>>> 1、301是什么? 其实就是HTTP状态表。就是当用户输入url请求时,服务器的一个反馈状态。 详细链接http://www.cnblogs.com/kunhony/archive/2006/06/16/427305.html 2、common.inc.php和arc.partvi…

OpenCV-Python:K值聚类

关于K聚类,我曾经在一篇博客中提到过,这里简单的做个回顾。 KMeans的步骤以及其他的聚类算法 K-均值是因为它可以发现k个不同的簇,且每个簇的中心采用簇中所含值的均值计算 其他聚类算法:二分K-均值 讲解一下步骤,其实…

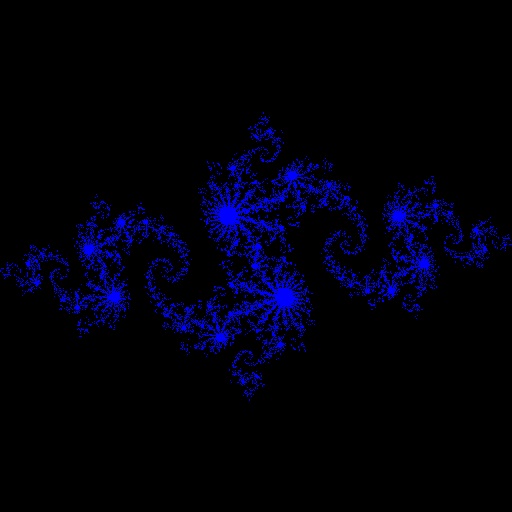

CUDA Samples: Julia

以下CUDA sample是分别用C和CUDA实现的绘制Julia集曲线,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第四章,各个文件内容如下:funset.cpp:#include "funset.hpp" #include <rand…

给初学者的深度学习入门指南

从无人驾驶汽车到AlphaGo战胜人类,机器学习成为了当下最热门的技术。而机器学习中一种重要的方法就是深度学习。作为一个有理想的程序员,若是不懂人工智能(AI)领域中深度学习(DL)这个超热的技术,…

epoll/select

为什么80%的码农都做不了架构师?>>> epoll相对select优点主要有三: 1. select的句柄数目受限,在linux/posix_types.h头文件有这样的声明:#define __FD_SETSIZE 1024 表示select最多同时监听1024个fd。而epoll没…

CUDA Samples: ripple

以下CUDA sample是分别用C和CUDA实现的生成的波纹图像,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第五章,各个文件内容如下:funset.cpp:#include "funset.hpp" #includ…

Python告诉你这些旅游景点好玩、便宜、人又少!

(图片由CSDN付费下载自东方IC)作者 | 猪哥来源 | 裸睡的猪(ID:IT--Pig) 2019年国庆马上就要到来,今年来点新花样吧,玩肯定是要去玩的,不然怎么给祖国庆生?那去哪里玩&…

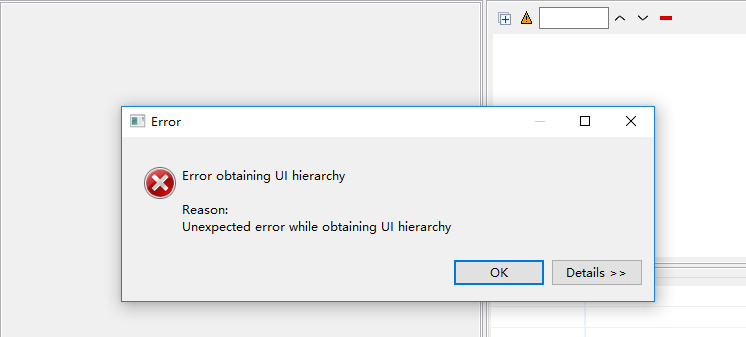

手机APP自动化之uiautomator2 +python3 UI自动化

题记: 之前一直用APPium直到用安卓9.0 发现uiautomatorviewer不支持安卓 9.0,点击截屏按钮 一直报错,百度很久解决方法都不可以,偶然间看见有人推荐:uiautomator2 就尝试使用 发现比appium要简单一些; 下面…

爱上MVC3系列~开发一个站点地图(俗称面包屑)

回到目录 原来早在webform控件时代就有了SiteMap这个东西,而进行MVC时代后,我们也希望有这样一个东西,它为我们提供了不少方便,如很方便的实现页面导航的内容修改,页面导航的样式换肤等. 我的MvcSiteMap主要由实体文件,XML配置文件,C#调用文件组成,当然为了前台使用方便,可以为…

Django web框架-----Django连接现有mysql数据库

第一步:win10下载mysql5.7压缩包配置安装mysql,创建数据库或导入数据库 第二步:win10搭建django2.1.7开发环境,创建项目为mytestsite,创建应用app为quicktool 第三步:编辑与项目同名的文件夹的配置文件&…

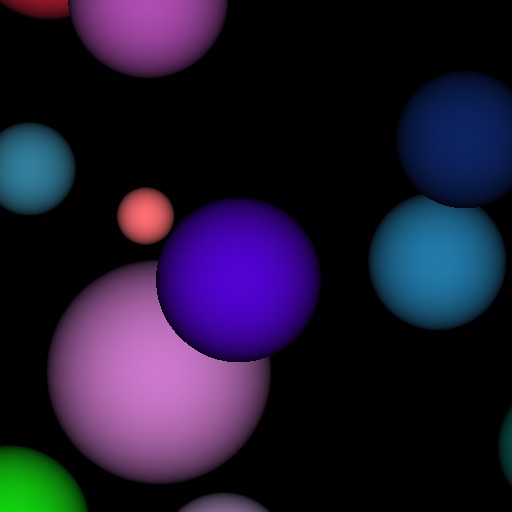

CUDA Samples: green ball

以下CUDA sample是分别用C和CUDA实现的生成的绿色的球图像,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第五章,各个文件内容如下:funset.cpp:#include "funset.hpp" #include <r…

ICLR 2020论文投稿2600篇,GNN、BERT、Transformer领跑热门研究方向

(图片由AI科技大本营付费下载自视觉中国)出品 | AI科技大本营(ID:rgznai100)2019 年 4,ICLR 2020 论文征集活动开始,截止 9 月 25 日,大会共收到近 2600 篇投稿,相比 ICL…

android环境安装之android4.2安装(转)

准备学习android,着手安装android时听说很麻烦,在网上看了很多android安装说明,都是android比较早的版本,我这里安装了android4.2,简单记录一下。 安装分为几步,首先申明,安装时最好保持网络畅通…

如何创建一个百分百懂你的产品推荐系统 | 深度教程(附代码详解)

(图片由AI科技大本营付费下载自视觉中国)来源 | 读芯术(ID:AI_Discovery)你也许每天都会逛一逛电子商务网站,或者从博客、新闻和媒体出版物上阅读大量文章。浏览这些东西的时候,最令读者或者用户…

CUDA Samples: Ray Tracking

以下CUDA sample是分别用C和CUDA实现的生成光线跟踪图像,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第六章,CUDA各实现包括了使用常量内存和不使用常量内存两种方法,各个文件内容如下&#x…

从产品的适用性以及费用方面考虑

物联宇手持终端在对比性价比高低应该从产品的适用性以及费用方面考虑。不过在选择时不一定要整机,可以按实际需求让厂商定做和行业需要功能的手持机,这样有针对性的定制更能体现整体的性价效率。转载于:https://blog.51cto.com/14222294/2386642

杨学海:跨境电商新通道-进口保税直邮模式解析

为什么80%的码农都做不了架构师?>>> 杨学海:跨境电商新通道-进口保税直邮模式解析 广州威云供应链管理公司总经理杨学海在第九届中国中小企业电子商务大会上表示,其品牌海外通要为跨境电子商务提供一个更加快速、便捷、低成本&am…

CUDA Samples: heat conduction(模拟热传导)

以下CUDA sample是分别用C和CUDA实现的模拟热传导生成的图像,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第七章,各个文件内容如下:funset.cpp:#include "funset.hpp" #include <…

2020应届生:今年秋招也太太太太太难了吧!

讲个简短的鬼故事:2020秋招已经过去一大半了!回顾9月,你可能以为秋招还有很多机会,还有大把时间准备。然而各大名企的实际进度却不等人。阿里巴巴9月12日网申截止;腾讯9月15日网申截止;宝洁9月20日关闭网申…

PDF文字怎么编辑,PDF文档编辑方法

有时候遇到PDF文件不是自己制作的或者是制作的有点匆忙,会有文字遗漏或者打错的时候,我们使用就会有点麻烦就需要把文件中的文字进行编辑修改,那么具体怎么做呢?小伙伴们都挺好奇吧,今天就来跟大家分享一下。操作软件&…

浏览器是怎样工作的:渲染引擎,HTML解析

2019独角兽企业重金招聘Python工程师标准>>> 渲染引擎 渲染引擎的职责是……渲染,也就是把请求的内容显示到浏览器屏幕上。 默认情况下渲染引擎可以显示HTML,XML文档以及图片。 通过插件(浏览器扩展)它可以显示其它类型…

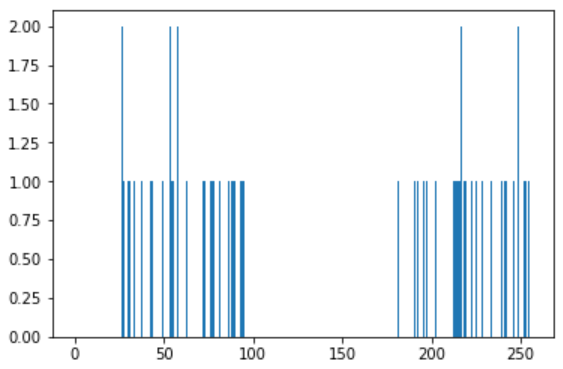

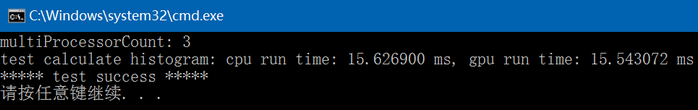

CUDA Samples: Calculate Histogram(atomicAdd)

以下CUDA sample是分别用C和CUDA实现的计算一维直方图,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第九章,各个文件内容如下:funset.cpp:#include "funset.hpp" #include <rando…

glusterfs基本操作

基本操作 集群节点 扩展集群 1,必须做hosts域名解析其实通过IP地址也能做集群,但是不建议这种方式. 192.168.1.210 glusterfs04 2, 添加节点到集群中,在当前所有集群节点中都需要执行 gluster peer probe glusterfs04 3,查看对等状态 gluster peer status 查看集群节点信息 gl…

100多次竞赛后,他研发了一个几乎可以解决所有机器学习问题的框架

(图片由AI科技大本营付费下载自视觉中国)作者 | XI YANG来源 | 知乎(机器学习之路)一个叫 Abhishek Thakur 的数据科学家,在他的 Linkedin 发表了一篇文章 Approaching (Almost) Any Machine Learning Problem…

mysql中char与varchar的区别分析(补充一句,int和integer没区别)

转自:http://www.jb51.net/article/23575.htm 在mysql教程中char与varchar的区别呢,都是用来存储字符串的,只是他们的保存方式不一样罢了,char有固定的长度,而varchar属于可变长的字符类型。har与varchar的区别 &#…

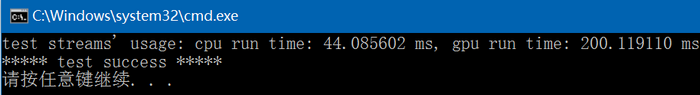

CUDA Samples: Streams' usage

以下CUDA sample是分别用C和CUDA实现的流的使用code,并对其中使用到的CUDA函数进行了解说,code参考了《GPU高性能编程CUDA实战》一书的第十章,各个文件内容如下:funset.cpp:#include "funset.hpp" #include <random&…

你的神经网络不起作用的37个理由

(图片由AI科技大本营付费下载自视觉中国)作者 | Slav Ivanov译者 | 吴金笛校对 | 丁楠雅、林亦霖编辑 | 王菁来源 | 数据派THU(ID:DatapiTHU)【导语】本文列举了在搭建神经网络过程中的37个易错点,并给出了…

菜鸟Vue学习笔记(三)

菜鸟Vue学习笔记(三)本周使用了Vue来操作表单,接下来说下Vue中双向绑定表单元素的用法。Vue中双向绑定是使用的v-model,所谓的双向绑定即改变变量的值,表单元素的值也会改变,同样的,改变表单元素…

Python中的注释(转)

一、单行注释单行注释以#开头,例如:print 6 #输出6二、多行注释(Python的注释只有针对于单行的注释(用#),这是一种变通的方法)多行注释用三引号将注释括起来,例如:多行注释多行注释三…