如何将TensorFlow Serving的性能提高超过70%?

点击上方↑↑↑蓝字关注我们~

点击上方↑↑↑蓝字关注我们~「2019 Python开发者日」7折优惠最后2天,请扫码咨询 ↑↑↑

译者 | Major

出品 | AI科技大本营(ID:rgznai100)

TensorFlow已经发展成为事实上的ML(机器学习)平台,在业界和研究领域都很流行。对TensorFlow的需求和支持促成了一系列围绕培训和服务ML模型的OSS库、工具和框架。TensorFlow Serving是一个构建在分布式生产环境中、主要为ML模型提供推理服务的项目。

Mux在其基础设施的几个部分中使用TensorFlow Serving,我们之前已经讨论过使用TensorFlow来实现按标题编码(per-title-encoding)功能。今天,我们将重点关注通过优化预测服务器和客户端来改善延迟的技术。模型预测通常是“在线”操作(在关键的应用请求路径上),因此我们的主要优化目标是以尽可能低的延迟处理大量的请求。

首先,让我们简要介绍一下TensorFlow Serving。

什么是TensorFlow Serving?

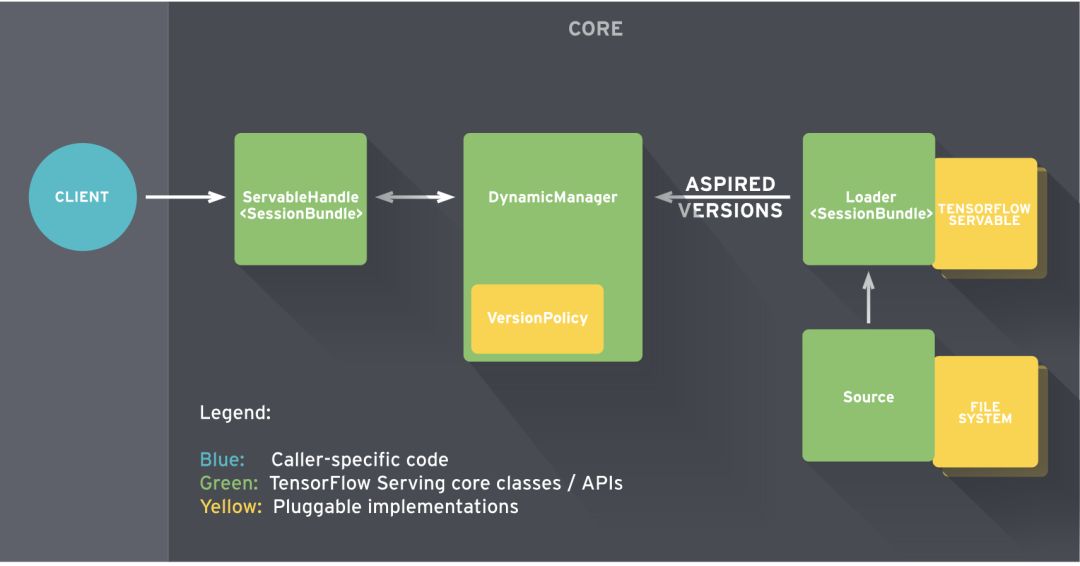

TensorFlow Serving提供了灵活的服务器架构,旨在部署和服务ML模型。一旦模型经过训练并可以用于预测,TensorFlow Serving需要将模型导出到可服务类(Servable)兼容格式。

Servable是包装TensorFlow对象的中心抽象。例如,模型可以表示为一个或多个Servable。因此,Servable是客户端用于执行计算(如推理)的底层对象。Servable的大小很重要,由于较小的模型使用更少的内存、更少的存储,因此将有更快的加载时间(加载时间更短)。Servable要求模型以SavedModel格式加载,并使用PerdictAPI提供服务。

TensorFlow Serving将核心服务组件组合在一起,构建一个GRPC/HTTP服务器。该服务器可以服务多个ML模型(或多个版本),并提供监测组件和可配置的体系结构。

Tensorflow Serving and Docker

让我们使用标准的TensorFlow Serving获得基线预测性能延迟指标(未使用CPU优化)。

首先,从TensorFlow Docker hub提取最新的服务映像文件:

docker pull tensorflow/serving:latest

在这篇文章中,所有的容器都运行在一个4核、15 GB、Ubuntu 16.04主机上。

将TensorFlow模型导出到SavedModel格式

使用TensorFlow训练模型时,可以将输出保存为可变检查点(磁盘上的文件)。推理可以通过恢复模型检查点或在其转换的静态图(二进制)上直接运行。

为了使用TensorFlow服务这些模型,必须静态图导出到SavedModel格式。TensorFlow文档可查询以SavedModel格式导出预训练模型的示例。

TensorFlow还提供了一系列官方和研究模型作为实验、研究或生产的入门资料。

例如,我们将使用深残余网络(ResNet)模型,可用于对ImageNet的1000个类的数据集进行分类。下载预训练 ResNet-50 v2模型,特别是 channels_last (NHWC)卷积SavedModel,这对于CPU来说通常更好。

在以下结构中复制RestNet模型目录:

models/

1/

saved_model.pb

variables/

variables.data-00000-of-00001

variables.index

TensorFlow Serving按数字排序的目录结构管理模型版本。在本例中,目录1/对应于模型版本1,其中包含模型体系结构。saved_model.pb以及模型权重(变量)的快照。

加载和服务SavedModel

下面的命令在docker容器中启动一个TensorFlow模型服务器。为了加载SavedModel,需要将模型的主机目录mount到预期的容器目录中。

docker run -d -p 9000:8500 \

-v $(pwd)/models:/models/resnet -e MODEL_NAME=resnet \

-t tensorflow/serving:latest

检查容器日志,确定ModelServer正在运行并可以在GRPC和HTTP端点上为resnet模型提供服务:

I tensorflow_serving/core/loader_harness.cc:86] Successfully loaded servable version {name: resnet version: 1}

I tensorflow_serving/model_servers/server.cc:286] Running gRPC ModelServer at 0.0.0.0:8500 ...

I tensorflow_serving/model_servers/server.cc:302] Exporting HTTP/REST API at:localhost:8501 ...

预测客户端

TensorFlow将API服务模式定义为协议缓冲器(protobuf)。预测API的gRPC客户端用例会被打包为tensorflow_serving.apis Python包。考虑到实用功能,我们还需要tensorflow Python包。

让我们安装倚赖项(dependencies)创建一个简单的客户端:

virtualenv .env && source .env/bin/activate && \

pip install numpy grpcio opencv-python tensorflow tensorflow-serving-api

ResNet-50 v2模型要求浮点Tensor输入应采用Channel_last(NHWC)格式的数据结构。因此,输入图像是使用OpenCV-python读取的,它以32位浮点数据类型加载到numpy数组(高度x宽度x通道)中。下面的脚本创建预测客户端存根,并将JPEG图像数据加载到numpy数组中,然后转换为TensorProto以发出GRPC预测请求:

#!/usr/bin/env python

from __future__ import print_function

import argparse

import numpy as np

import time

tt = time.time()

import cv2

import tensorflow as tf

from grpc.beta import implementations

from tensorflow_serving.apis import predict_pb2

from tensorflow_serving.apis import prediction_service_pb2

parser = argparse.ArgumentParser(description='incetion grpc client flags.')

parser.add_argument('--host', default='0.0.0.0', help='inception serving host')

parser.add_argument('--port', default='9000', help='inception serving port')

parser.add_argument('--image', default='', help='path to JPEG image file')

FLAGS = parser.parse_args()

def main():

# create prediction service client stub

channel = implementations.insecure_channel(FLAGS.host, int(FLAGS.port))

stub = prediction_service_pb2.beta_create_PredictionService_stub(channel)

# create request

request = predict_pb2.PredictRequest()

request.model_spec.name = 'resnet'

request.model_spec.signature_name = 'serving_default'

# read image into numpy array

img = cv2.imread(FLAGS.image).astype(np.float32)

# convert to tensor proto and make request

# shape is in NHWC (num_samples x height x width x channels) format

tensor = tf.contrib.util.make_tensor_proto(img, shape=[1]+list(img.shape))

request.inputs['input'].CopyFrom(tensor)

resp = stub.Predict(request, 30.0)

print('total time: {}s'.format(time.time() - tt))

if __name__ == '__main__':

main()

使用JPEG图像作为输入,运行客户端的输出如下所示:

python tf_serving_client.py --image=images/pupper.jpg

total time: 2.56152906418s

输出Tensor的预测结果为一个整数值和各特征的概率。

outputs {

key: "classes"

value {

dtype: DT_INT64

tensor_shape {

dim {

size: 1

}

}

int64_val: 238

}

}

outputs {

key: "probabilities"

...

对于单个请求,这种预测延迟是不可接受的。然而,这并非完全出乎意料;默认的TensorFlow二进制程序的目标是支持最广泛的硬件以覆盖绝大多数用例。您可能已经从标准的TensorFlow容器日志中注意到:

I external/org_tensorflow/tensorflow/core/platform/cpu_feature_guard.cc:141] Your CPU supports instructions that this TensorFlow binary was not compiled to use: AVX2 FMA

这表明TensorFlow二进制程序运行在不兼容的CPU平台上,而该平台没有为其进行优化。

构建CPU优化服务二进制代码

根据 TensorFlow文献资料,建议从源代码编译TensorFlow,并采用运行二进制文件的主机平台的CPU提供的所有优化。TensorFlow给出了Build选项标志,以便为特定于平台的CPU指令集构建二进制代码:

指令集 | 标志 |

AVX | -Copt=-mavx |

AVX 2 | -Copt=-mavx 2 |

FMA | --copt=-mfma |

SSE 4.1 | -Copt=-msse4.1 |

SSE 4.2 | -Copt=-msse4.2 |

全部由处理器支持 | --copt=-march=native |

克隆TensorFlow固定到特定版本。在这种情况下,我们将使用1.13(发表此文时的最新版本):

USER=$1

TAG=$2

TF_SERVING_VERSION_GIT_BRANCH="r1.13"

git clone --branch="$TF_SERVING_VERSION_GIT_BRANCH" https://github.com/tensorflow/serving

TensorFlow Serving映像使用Bazel作为Build工具。针对特定处理器CPU指令集的生成目标可以用如下方式指定:

TF_SERVING_BUILD_OPTIONS="--copt=-mavx --copt=-mavx2 --copt=-mfma --copt=-msse4.1 --copt=-msse4.2"

如果内存有限制,则使用--local_resources=2048,.5,1.0标志。参考TensorFlow与Docker联合服务和Bazel docs的文献作为这些构建标志上的资源。

使用开发图像建立serving image作为服务基类:

USER=$1

TAG=$2

TF_SERVING_VERSION_GIT_BRANCH="r1.13"

git clone --branch="${TF_SERVING_VERSION_GIT_BRANCH}" https://github.com/tensorflow/serving

TF_SERVING_BUILD_OPTIONS="--copt=-mavx --copt=-mavx2 --copt=-mfma --copt=-msse4.1 --copt=-msse4.2"

cd serving && \

docker build --pull -t $USER/tensorflow-serving-devel:$TAG \

--build-arg TF_SERVING_VERSION_GIT_BRANCH="${TF_SERVING_VERSION_GIT_BRANCH}" \

--build-arg TF_SERVING_BUILD_OPTIONS="${TF_SERVING_BUILD_OPTIONS}" \

-f tensorflow_serving/tools/docker/Dockerfile.devel .

cd serving && \

docker build -t $USER/tensorflow-serving:$TAG \

--build-arg TF_SERVING_BUILD_IMAGE=$USER/tensorflow-serving-devel:$TAG \

-f tensorflow_serving/tools/docker/Dockerfile .

ModelServer可以用TensorFlow专用标志配置以启用会话并行性。以下选项配置两个线程池并行执行:

intra_op_parallelism_threads

控制用于单个操作并行执行的最大线程数。

用于具有固有非倚赖子操作的并行执行。

inter_op_parallelism_threads

控制独立的不同操作并行执行的最大线程数。

对TensorFlow Graph的操作彼此独立,因此可以在不同的线程上运行。

这两个选项的默认值设置为0。这意味着,系统选择一个适当的数字,这通常需要每个CPU核心有一个线程可用。但是,对于多核CPU并行性,我们可以手动控制。

接下来,按照与之前类似的方式启动服务容器,这一次使用从源代码编译的docker映像,并使用TensorFlow特定的CPU优化标志:

docker run -d -p 9000:8500 \

-v $(pwd)/models:/models/resnet -e MODEL_NAME=resnet \

-t $USER/tensorflow-serving:$TAG \

--tensorflow_intra_op_parallelism=4 \

--tensorflow_inter_op_parallelism=4

容器日志应该不显示CPU guard告警。在不更改任何代码的情况下,运行相同的预测请求会使预测延迟降低约35.8%:

python tf_serving_client.py --image=images/pupper.jpg

total time: 1.64234706879s

提高预测客户端的速度

我们能做得更好吗?服务器端已经为其CPU平台进行了优化,但超过1s的预测延迟似乎仍然太高。

问题是,加载tensorflow_serving和tensorflow库确实会导致这个问题。每次调用tf.contrib.util.make_tensor_proto同时也增加了不必要的延迟开销。

“等等”,你可能在想。“难道我不需要TensorFlow Python包向TensorFlow Server提出预测请求吗?”

答案很简单:确实如此,实际上不需要tensorflow或tensorflow_serving包发出预测请求。

如前所述,TensorFlow预测API被定义为Protobufs。因此,可以通过生成必要的tensorflow和tensorflow_serving protobuf python 存根(stubs)。这就避免了对客户机本身整个(巨大)TensorFlow库的调用。

首先,舍弃tensorflow和tensorflow_serving依赖项,添加grpcio-tools包。

pip uninstall tensorflow tensorflow-serving-api && \

pip install grpcio-tools==1.0.0

复制tensorflow/tensorflow和tensorflow/serving存储库,并将以下Protobuf文件复制到客户端项目中:

tensorflow/serving/

tensorflow_serving/apis/model.proto

tensorflow_serving/apis/predict.proto

tensorflow_serving/apis/prediction_service.proto

tensorflow/tensorflow/

tensorflow/core/framework/resource_handle.proto

tensorflow/core/framework/tensor_shape.proto

tensorflow/core/framework/tensor.proto

tensorflow/core/framework/types.proto

将上述原型文件复制到protos/目录并保存原始路径:

protos/

tensorflow_serving/

apis/

*.proto

tensorflow/

core/

framework/

*.proto

为了简单起见,prediction_service.proto(预测服务)可以简化为只实现Predict RPC。这避免了引入服务中定义的其他RPC的嵌套依赖关系。这里是简化后的prediction_service.proto.

使用grpcio.tools.protoc:

PROTOC_OUT=protos/

PROTOS=$(find . | grep "\.proto$")

for p in $PROTOS; do

python -m grpc.tools.protoc -I . --python_out=$PROTOC_OUT --grpc_python_out=$PROTOC_OUT $p

done

现在可以删除整个tensorflow_serving模块:

from tensorflow_serving.apis import predict_pb2

from tensorflow_serving.apis import prediction_service_pb2

中生成的Probufs替换为protos/tensorflow_serving/apis:

from protos.tensorflow_serving.apis import predict_pb2

from protos.tensorflow_serving.apis import prediction_service_pb2

为了使用帮助函数make_tensor_proto,导入了TensorFlow库,也就是用于包装python/numpy对象成为TensorProto对象。

因此,我们可以替换以下依赖项和代码片段:

import tensorflow as tf

...

tensor = tf.contrib.util.make_tensor_proto(features)

request.inputs['inputs'].CopyFrom(tensor)

导入Protobuf,构建TensorProto对象:

from protos.tensorflow.core.framework import tensor_pb2

from protos.tensorflow.core.framework import tensor_shape_pb2

from protos.tensorflow.core.framework import types_pb2

...

tensor_shape = [1]+list(img.shape)

dims = [tensor_shape_pb2.TensorShapeProto.Dim(size=dim) for dim in tensor_shape]

tensor_shape = tensor_shape_pb2.TensorShapeProto(dim=dims)

tensor = tensor_pb2.TensorProto(

dtype=types_pb2.DT_FLOAT,

tensor_shape=tensor_shape,

float_val=list(img.reshape(-1)))

request.inputs['inputs'].CopyFrom(tensor)

完整的python脚本请访问这里。运行更新后的初始客户端,该客户端向优化的TensorFlow发出预测请求:

python tf_inception_grpc_client.py --image=images/pupper.jpg

total time: 0.58314920859s

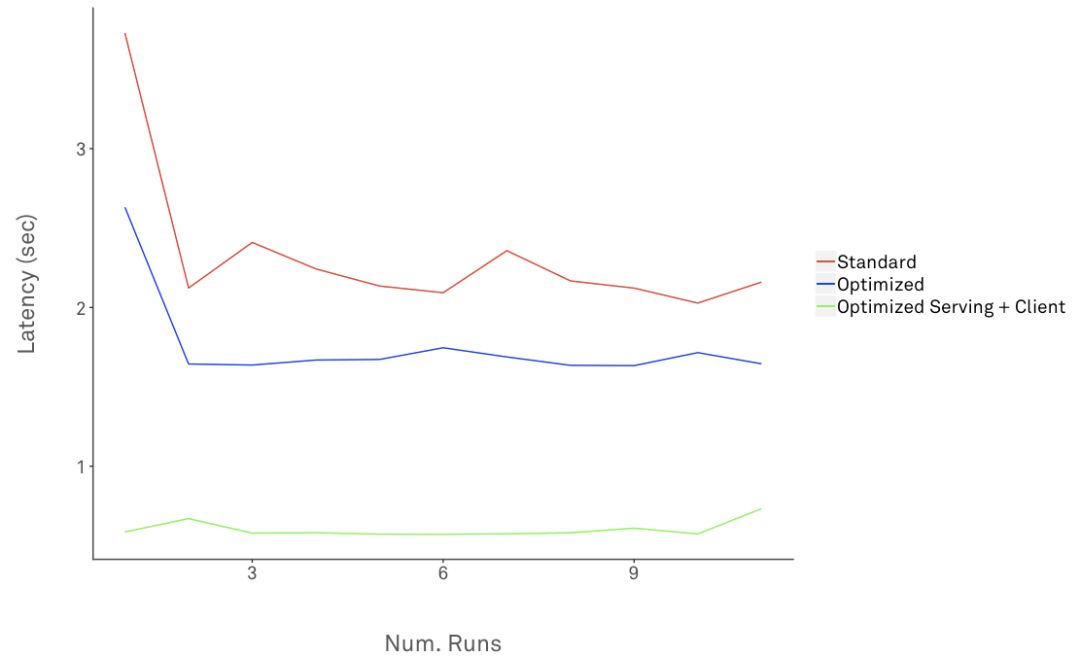

下图显示了针对标准、优化的TensorFlow和客户端10次运行的预测请求的延迟:

显然,从标准TensorFlow到优化版的平均延迟下降了约70.4%。

优化预测吞吐量

TensorFlow Serving也可以配置为高吞吐量处理。对吞吐量的优化通常用于“脱机”批处理,在这些批处理中,不需要有严格的延迟阀值。

(1) 服务器端批处理

服务器端批处理由TensorFlow Serving支持开箱即用。.

延迟和吞吐量之间的权衡取决于所支持的批处理参数。TensorFlow批处理最有效地利用硬件加速器承诺(保证)的高吞吐量。

若要启用批处理,请设置--enable_batching和--batching_parameters_file标志。可以将批处理参数设置为SessionBundleConfig。对于只使用CPU的系统,请考虑设置num_batch_threads可以使用的核心数量。批处理配置方法可访问这里,使用支持GPU的系统。

当服务器端的批处理请求全部到达时,推理请求在内部合并为单个大请求(Tensor),并在合并请求上运行一个TensorFlow会话。在单个会话上运行批量请求,可以真正利用CPU/GPU并行性。

批处理过程中需要考虑的Tensorflow Serving Batching进程:

在客户端使用异步请求,以在服务器端进行批处理

在CPU/GPU上加入模型图组件,加速批处理

在同一服务器服务多个模型时,对预测请求进行交织处理

对于“脱机”大容量推理处理,强烈推荐批处理。

(2) 客户端批处理

客户端的批处理是将多个输入组合在一起,以发出单个请求。

由于ResNet模型要求以NHWC格式输入(第一个维度是输入的数量),所以我们可以将多个输入图像聚合到一个RPC请求中:

...

batch = []

for jpeg in os.listdir(FLAGS.images_path):

path = os.path.join(FLAGS.images_path, jpeg)

img = cv2.imread(path).astype(np.float32)

batch.append(img)

...

batch_np = np.array(batch).astype(np.float32)

dims = [tensor_shape_pb2.TensorShapeProto.Dim(size=dim) for dim in batch_np.shape]

t_shape = tensor_shape_pb2.TensorShapeProto(dim=dims)

tensor = tensor_pb2.TensorProto(

dtype=types_pb2.DT_FLOAT,

tensor_shape=t_shape,

float_val=list(batched_np.reshape(-1)))

request.inputs['inputs'].CopyFrom(tensor)

对N个图像的批处理,响应(相应)的输出Tensor对于请求批处理中相同数量的输入具有预测结果,在这种情况下,N=2(以下是N=2的情况):

outputs {

key: "classes"

value {

dtype: DT_INT64

tensor_shape {

dim {

size: 2

}

}

int64_val: 238

int64_val: 121

}

}

...

硬件加速

关于GPU:

对于训练,GPU可以更直观地利用并行化,因为构建深层神经网络需要大量的计算才能得到最优解。

然而,推理的情况并不总是如此。很多时候,当图形执行步骤放置在GPU设备上时,CNN的推理就会加快。然而,挑选能够优化性价比的硬件,需要进行严格的测试、深入的技术和成本分析。硬件加速并行化对于“脱机”推理批处理(海量卷)更有价值。

在引入GPU处理之前,要考虑业务需求,并对收益(严格延迟、高吞吐量)进行彻底的成本(货币、操作、技术)分析。

原文链接:

https://mux.com/blog/tuning-performance-of-tensorflow-serving-pipeline/

(本文为 AI科技大本营编译文章,转载请微信联系 1092722531)

◆

精彩推荐

◆

「2019 Python开发者日」7折票限时开售!这一次我们依然“只讲技术,拒绝空谈”10余位一线Python技术专家共同打造一场硬核技术大会。更有深度培训实操环节,为开发者们带来更多深度实战机会。

目前演讲嘉宾议题已确认,扫描海报二维码,即刻抢购7折优惠票价!更多详细信息请咨询13581782348(微信同号)。

推荐阅读:

特朗普盯上谷歌在华AI中心,CEO皮查伊上演“拉锯战”

教育部发文35所高校新增AI本科专业!想回去重新高考

儿科医生的眼泪,全被数据看见了

让苹果“沦为配角”的华为都发布了什么?

@程序员,编程语言大乱斗,今天你真香了吗?

人间真实!一行代码引发的恐惧

阿里带火的中台,究竟是个啥?

姚期智提出的"百万富翁"难题被破解? 多方安全计算MPC到底是个什么鬼?

曝光!月薪5万的程序员面试题:73%人都做错,你敢试吗?

你也可以点击阅读原文,查看大会详情。

相关文章:

【leetcode】力扣刷题(3):无重复字符的最长子串(go语言)

一、问题描述 给定一个字符串,请你找出其中不含有重复字符的 最长子串 的长度。 示例 1: 输入: “abcabcbb” 输出: 3 解释: 因为无重复字符的最长子串是 “abc”,所以其长度为 3。 示例 2: 输入: “bbbbb” 输出: 1 解释: 因为无重复字符的最长子串是…

单点登录与权限管理本质:session和cookie介绍

本篇开始写「单点登录与权限管理」系列的第一部分:单点登录与权限管理本质,这部分主要介绍相关的知识概念、抽象的处理过程、常见的实现框架。通过这部分的介绍,能够对单点登录与权限管理有整体上的了解,对其相关概念、处理流程、…

【.Net MF网络开发板研究-04】Socket编程之服务端

前几篇文章介绍了Http相关的应用,其实从技术角度而言,应该先介绍Socket编程,然后再介绍Http,毕竟Http是用Socket相关函数编程实现的。 .NET Micro Framework的Socket函数和桌面版.NET Framework中的函数完全兼容,换句话…

【Qt】Qt中调用python接口

在Qt程序中调用python函数从步骤 1、在pro中添加python的头文件路径和库 INCLUDEPATH += /usr/include/python3.4 LIBS += -L /usr/lib/python3.4/config-3.4m-x86_64-linux-gnu -lpython3.42、添加python头文件 #undef slots #include <python3.4/Python.h> #define …

优雅的理解 call 和 apply 的使用方法

作者在看到一篇优雅的使用 js 的各种方法解决算法的时候产生的疑问,到底什么时候使用 apply 和 call 啦? 每次看到别人用 apply 和 call 其实从以前的懵懵懂懂到现在的明白,但是自己从来未下手去用过,最近比较闲。开始打一下 Jav…

何恺明等人提TensorMask框架:比肩Mask R-CNN,4D张量预测新突破

整理 | 刘畅、Jane 责编 | Jane 出品 | AI科技大本营(id:rgznai100) 看到今天要给大家介绍的论文,也许现在大家已经非常熟悉 Ross Girshic、Piotr Dollr 还有我们的大神何恺明的三人组了。没错,今天这篇重磅新作还是他们的产出&am…

init.rc的disabled含义

http://www.kandroid.org/android_pdk/bring_up.htmlhttp://androidnote.com/Article_show.asp?ArticleID649如果该服务选项中没有disabled定义,则在init.rc中解析到这个服务的时候,会马上执行这个服务。而如果在服务的选项中增加了disabled定义&#x…

【Qt】在ubuntu14.04上安装Qt5.12(失败)

注意 在ubuntu14.04上安装Qt5.12最终失败了,Qt5.12需要的libdbus库的版本和ubuntu14.04中的不一致,如果强行升级libdbus库版本,会导致系统桌面无法启动。 再次提示:不要按照下述步骤操作,它只是一个记录失败操作的笔记。 如果有大神安装成功了,还请不吝赐教。 1、安装Q…

80+机器学习数据集,还不快收藏

整理 | suiling 出品 | AI科技大本营(ID:rgznai100) 对于从事机器学习的小伙伴来说,机器学习必须以大量的数据为基础,否则构建再好的模型也不能达到你想要的效果。同时,不同质量的数据集也会影响到模型训练的效果。之…

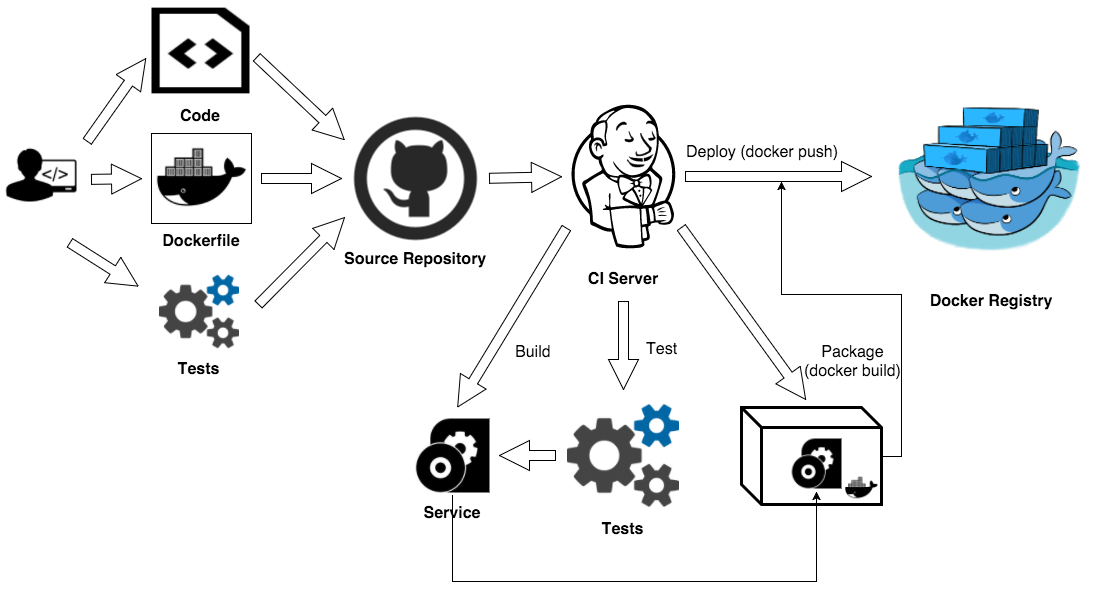

SpringBoot+Docker+Git+Jenkins实现简易的持续集成和持续部署

前言 本篇文章引导你使用Jenkins部署[SpringBoot项目],同时使用Docker和Git实现简单的持续集成和持续部署。(项目地址:sso-merryyou) 流程图如下: push代码到Github触发WebHook。(因网络原因,本篇使用gitee…

LINUX下用C语言历遍目录 C语言列出目录

(被考了一题遍历目录,连需要的系统库函数我都不知道...打击中...)小羽给了一个答案:#include<stdio.h> #include<dirent.h>int main(int argc,char **argv) { DIR *p; struct dirent *dirp; if (argc ! 2) …

【linux】ubuntu14.04升级dbus到1.13.8,杯具了,无法进入桌面

一、问题描述 在ubuntu14.04中安装了Qt5.12,启动QtCreator报错,需要高版本的dbus。 将dbus升级到1.13.8后,杯具了,无法进入桌面 二、尝试解决 1、尝试恢复之前的版本(失败) 进入终端界面:Ct…

线下教育地位遭冲击?“AI+教育”公司同台讲了这些事实

点击上方↑↑↑蓝字关注我们~「2019 Python开发者日」7折优惠最后1天,请扫码咨询 ↑↑↑整理 | 一一出品 | AI科技大本营(ID:rgznai100)近日,网易新闻、网易有道、清华大学数据科学研究院在清华大学举办了“中国AI创新者论坛”。当…

mysql查看正在执行的sql语句

有2个方法: 1、使用processlist,但是有个弊端,就是只能查看正在执行的sql语句,对应历史记录,查看不到。好处是不用设置,不会保存。 -- use information_schema; -- show processlist; 或者: -- …

poj2472

最短路,bellman View Code #include <iostream>#include <cstdio>#include <cstdlib>#include <cstring>#include <cmath>using namespace std;#define inf 0x3f3f3f3f#define maxn 100#define maxm 10000#define eps 10e-9int n, m…

.net core 2.0 部署到centos 7生产环境

.netcore的跨平台如此之火,忍不住想试试 在linux下部署 .net 程序。 借鉴此篇博文:将ASP.NET Core应用程序部署至生产环境中(CentOS7) 虽然是借鉴,但过程坎坷。对从未使用过linux的我难度可想而知,但万事有…

微软沈向洋:写给AI新潮流——人工智能创作的五点建议

2019年EmTech 数字大会 本周,我有幸在旧金山举行的EmTech数字大会上发言,为大家讲述了当今人工智能发展的现状,以及未来的发展方向。我想与大家分享的是,面对新一轮的人工智能创新大潮,人们最该思考的五件大事。 1)技…

【Linux】在VirtualBox-6.0中安装Manjaro18.0

1、参考博客: VMware虚拟机下Manjaro17.1.6安装详细教程 2、在VirtualBox-6.0中安装Manjaro18.0 1)基本步骤和博客中安装17.1.6相同,下面只记录不同的。 * VirtualBox中没有Manjaro的选项,可以选择 ArchLinux; * 本…

netty里集成spring注入mysq连接池(一)

netty的性能非常高,能达到8000rps以上,见 各个web服务器的性能对比测试 1.准备好需要的jar包 spring.jar //spring包 netty-3.2.4.Final.jar // netty库 commons-dbcp.jar // dbcp数据库连接池 mysql-connector-java-5.1.6.jar // d…

图很难理解?看这篇图论基础与图存储结构就够了

点击上方↑↑↑蓝字关注我们~「2019 Python开发者日」,购票请扫码咨询 ↑↑↑作者 | 程序员吴师兄转载自五分钟学算法(ID:CXYxiaowu)1 前言打算先普及一下图的相关理论支持,本文不建议一口气阅读完毕,可以先浏览一遍&a…

【Linux】修改/etc/fstab时参数设错,导致启动异常,无法进入系统(已解决)

1、问题描述 在ubuntu14.04上设置自动挂载硬盘分区时,修改/etc/fstab时,将defaults错误写成default,导致启动异常,无法进入系统。 2、解决方法 1)ubuntu启动时有两种模式:普通模式(ubuntu&am…

gitlab安装

根据官方文档安装:https://www.gitlab.com.cn/installation/#centos-6 centos6: 1、没有安装lokkit,yum search lokkit后安装lokkit sudo yum install -y curl policycoreutils-python openssh-server cronie sudo lokkit -s http -s ssh2、安…

如何将Android带入互联网数字家庭? 第一篇转载

前言:很有幸通过ARM Group认识了 ARM的家庭软件架构师 --- 章立(Leon Zhang) (他也是ARM战略软件联盟部门的一员. Leon 拥有多年产品开发和项目管理经验, 曾经参与了数字录像机、机顶盒、数字电视,网络电视以及智能电视࿰…

【linux】用过的shell命令

1、批量替换文件中的字符串 eg:将当前目录 . 下的old替换成new sed -i "s/new/old/g" grep old -rl .如果字符串中有‘/’等特殊字符需要反斜杠‘\’来转移 eg:将当前目录下的“old/old”,替换成“new/new” sed -i "s/new…

node简单实现excel文件下载

1.利用csv格式兼容实现 csv是一种利用,、\t、\n等分隔符存储的文本文件,excel可兼容打开,利用此原理,代码实现如下: app.use(route.get(/export, async ctx > {ctx.res.setHeader(Content-Type, application/vnd.ms-execl);ctx…

儿科医生的眼泪,全被数据看见了

点击上方↑↑↑蓝字关注我们~「2019 Python开发者日」,购票请扫码咨询 ↑↑↑作者 | AlfredWu来源 | Alfred数据室(ID:Alfred_Lab)《人间世》第二季第8集《儿科医生:坚守,还是逃离?》把儿科医生的辛苦与挣扎…

[毕业生的商业软件开发之路]C#类型样式

近期开始接触到在校学生、高校实习生和毕业生,在此说一下笔者对这些徘徊在职场门口的学生一些建议,希望能给这些初学者进入软件开发行业带来一些帮助,使得毕业生能更顺利的进入软件开发公司开始职场生涯,人生来一个完美的转弯。 -----------------------…

特斯拉被曝储存大量未加密个人数据 | 极客头条

点击上方↑↑↑蓝字关注我们~「2019 Python开发者日」,购票请扫码咨询 ↑↑↑编译丨王哲来源丨猎云网( ID:ilieyun)编者按:特斯拉是否明确界定了数据安全的目标?它现有的规则又在保护哪些人?如果…

【Linux】neocomplcache disabled: “sudo vim“ is detected and $HOME is set to your user‘s home

1、问题描述 使用sudo vim时,弹出提示: neocomplcache disabled: "sudo vim" is detected and $HOME is set to your users home. You may want to use the sudo.vim plugin, the "-H" option with "sudo" or set alwa…

016 | 漫谈区块链共识机制

原创文章,转载请注明:转载自Keegan小钢 并标明原文链接:http://keeganlee.me/post/blockchain/20180425 微信订阅号:keeganlee_me 写于2018-04-25 专栏地址:xiaozhuanlan.com/fullstack 共识机制是区块链的一个核心特征…