读完这45篇论文,“没人比我更懂AI了”

作者 | 黄海广

转载自机器学习爱好者(ID:ai-start-com)

导读:AI领域的发展会是IT中最快的。我们所看到的那些黑科技,其后无不堆积了大量论文,而且都是最新、最前沿的论文。从某种角度来讲,它们所用的技术跟书籍里的内容确实不是一个时代。要想与时俱进,就必须改变思路——从论文入手。今天给大家介绍45篇让你跟上AI时代的论文,读完后,相信你会比“全知全能”的特朗普更了解AI一分。

一、神经网络基础部分

No1 wide_deep模型论文:

关于神经元、全连接网络之类的基础结构,想必每个AI学者都有了解。那么你是否真的了解全连接网络中深层与浅层的关系呢?来看看wide_deep模型吧。这篇论文会使你对全连接有个更深刻的理解。

关于该模型的更多介绍可以参考论文:

https://arxiv.org/pdf/1606.07792.pdf

在wide_deep模型中,wide模型和deep模型具有各自不同的分工。

wide模型:一种浅层模型。它通过大量的单层网络节点,实现对训练样本的高度拟合性。它的缺点是泛化能力很差。

deep模型:一种深层模型。它通过多层的非线性变化,使模型具有很好的泛化性。它的缺点是拟合度欠缺。

将二者结合起来——用联合训练方法共享反向传播的损失值来进行训练—可以使两个模型综合优点,得到最好的结果。

No2 wide_deep模型论文:

为什么Adam被广泛使用?光会用可不行,还得把原理看懂。这样出去喷一喷,才会显得更有面子。

Adam的细节请参阅论文《Adam: A Method for Stochastic Optimization》,该论文的链接网址是:

https://arxiv.org/pdf/1412.6980v8.pdf

No3 Targeted Dropout模型论文:

你还再用普通的Dropout吗?我已经开始用Targeted Dropout了,比你的又快,又好。你不知道吧,赶紧学习一下。

Targeted Dropout不再像原有的Dropout那样按照设定的比例随机丢弃部分节点,而是对现有的神经元进行排序,按照神经元的权重重要性来丢弃节点。这种方式比随机丢弃的方式更智能,效果更好。更多理论见以下论文:

https://openreview.net/pdf?id=HkghWScuoQ

二、图像分类部分

No4 Xception模型论文:

在那个图像分类的时代,谷歌的Xception系列,像x战警一样,一个一个的打破记录。其中的技术也逐渐成为AI发展的知识体系。有必要看一下,或许会对自己的工作有所启发。

详细情况请查看原论文《Xception: Deep Learning with Depthwise Separable Convolutions》,该论文网址是:

https://arxiv.org/abs/1610.02357

No5 残差结构论文:

运气好到没朋友,现有模型,后完善理论指的就是残差结构这哥们。它的传奇导致即使到今天的AI技术,也无法将它割舍,就来常微分方程都得拿它比肩。快来学学吧,用处大着呢。好多模型都拿它当先锋。

利用残差结构,可以使得网络达到上百层的深度。详情请参阅原始论文《Deep ResidualLearning for Image Recognition》,该论文网址是:

https://arxiv.org/abs/1512.03385

No6 空洞卷积论文:

NasNet的招牌动作,虽然不是出于NASNet,但是却被人家用得如火纯青。有时不得不惊叹,机器设计出来的模型还真实跟人设计的不一样!

想知道空洞卷积的感受野为什么与层数呈指数级关系吗?

细节请查看原论文《Multi-scale context aggregation by dilated convolutions》,该论文网址是:

https://arxiv.org/abs/1511.07122v3

No7 DenseNet论文:

这个模型使我想到了“一根筋”,再次证明了只有轴的人才能成大事!另类的模型,神奇的效果,快来体验一下吧。这可是比华佗还牛的神医哦!

有关DenseNet模型的细节,请参考原始论文《Densely Connected Convolutional Networks》,该论文的连接是:

https://arxiv.org/abs/1608.06993

No8 EfficientNet模型论文:

知道目前位置图像分类界谁是老大吗?来,看看这个!

EfficientNet模型的论文地址如下:

https://arxiv.org/pdf/1905.11946.pdf

No9 Grad-CAM模型论文:

如果你能把神经元搞得透彻,你也会想到这个点子。不想聊太多!一个字“绝”!这TMD才叫卷积网络的可视化!

详细情况请参阅论文《Grad-CAM:Visual Explanations from Deep Networks via Gradient-based Localization》,该论文的链接网址是:

https://arxiv.org/pdf/1610.02391.pdf

No10 分类模型泛化能力论文:

知道为啥都喜欢使用ResNet模型当先锋吗?运气好就是运气好!好到大家都喜欢用它,还说不出为啥它那么好!反正就是好,不信的话看看这篇论文的实验结果。

论文中,在选取模型的建议中,多次提到了ResNet模型。原因是,ResNet模型在Imgnet数据集上输出的特征向量所表现的泛化能力是最强的。具体可以参考以下论文:

https://arxiv.org/pdf/1805.08974.pdf

三、批量正则化部分

No11 批量正则化论文:

这个没的说,必修课,不懂的话,会被鄙视成渣渣!

论文《Batch Normalization Accelerating Deep Network Training by Reducing Internal Covariate Shift》,该论文网址是:

https://arxiv.org/abs/1502.03167

No12 实例归一化论文:

时代不同了,批量归一化也升级了,赶紧学学新的归一化吧。

在对抗神经网络模型、风格转换这类生成式任务中,常用实例归一化取代批量归一化。因为,生成式任务的本质是——将生成样本的特征分布与目标样本的特征分布进行匹配。生成式任务中的每个样本都有独立的风格,不应该与批次中其他的样本产生太多联系。所以,实例归一化适用于解决这种基于个体的样本分布问题。详细说明见以下链接:

https://arxiv.org/abs/1607.08022

No13 ReNorm算法论文:

ReNorm算法与BatchNorm算法一样,注重对全局数据的归一化,即对输入数据的形状中的N维度、H维度、W维度做归一化处理。不同的是,ReNorm算法在BatchNorm算法上做了一些改进,使得模型在小批次场景中也有良好的效果。具体论文见以下链接:

https://arxiv.org/pdf/1702.03275.pdf

No14 GroupNorm算法论文:

GroupNorm算法是介于LayerNorm算法和InstanceNorm算法之间的算法。它首先将通道分为许多组(group),再对每一组做归一化处理。

GroupNorm算法与ReNorm算法的作用类似,都是为了解决BatchNorm算法对批次大小的依赖。具体论文见下方链接:

https://arxiv.org/abs/1803.08494

No15 SwitchableNorm算法论文:

我们国人做产品都喜欢这么干!all in one ,好吧。既然那么多批量归一化的方法。来,来,来,我们来个all in one吧。不服来辩,我这啥都有!

SwitchableNorm算法是将BN算法、LN算法、IN算法结合起来使用,并为每个算法都赋予权重,让网络自己去学习归一化层应该使用什么方法。具体论文见下方链接:

https://arxiv.org/abs/1806.10779

四、注意力部分

No16 大道至简的注意力论文:

把AI搞成玄学也就算了!居然还扯到道家了!谷歌的工程师真实中外通吃啊!搞出来了一个只用注意力就能做事的模型,连卷积都不要了!你说好玩不好玩!至简不至简!刺激不刺激!

大名鼎鼎的Attention is All You Need 注意力机制论文

注意力机制因2017年谷歌的一篇论文Attention is All You Need而名声大噪。下面就来介绍该技术的具体内容。如果想了解更多,还可以参考原论文,具体地址如下:

https://arxiv.org/abs/1706.03762

No17-18 孪生注意力论文:

好比LSTM与GRU一样,注意力它们家也除了一对双胞胎,长得略微有点不同。但是功能一样,都能吃能喝,还能注意。老虎老鼠傻傻的不清楚!

—BahdanauAttention:https://arxiv.org/abs/1409.0473。

—LuongAttention:https://arxiv.org/abs/1508.04025。

No19 各自升级的孪生注意力论文:

话说这对双胞胎,出生后就分开了。各自学的不同的语言,一个学习汉语,一个学习中文。若干年后,见面,发现二者的能力还是一样!

BahdanauAttention注意力升级成了normed_BahdanauAttention,而LuongAttention注意力升级成了scaled_LuongAttention。都一样的效果,你爱用哪个用哪个吧!

例如:

在BahdanauAttention类中有一个权重归一化的版本(normed_BahdanauAttention),它可以加快随机梯度下降的收敛速度。在使用时,将初始化函数中的参数normalize设为True即可。

具体可以参考以下论文:

https://arxiv.org/pdf/1602.07868.pdf

No20 单调注意力机制论文:

老公主动表忠心,我以后不看别的美女。老婆觉得不够,再加个限制:你以后不准看别的女人!于是单调注意力就出来了。

单调注意力机制(monotonic attention),是在原有注意力机制上添加了一个单调约束。该单调约束的内容为:

(1)假设在生成输出序列过程中,模型是以从左到右的方式处理输入序列的。

(2)当某个输入序列所对应的输出受到关注时,在该输入序列之前出现的其他输入将不能在后面的输出中被关注。

即已经被关注过的输入序列,其前面的序列中不再被关注。

更多描述可以参考以下论文:

https://arxiv.org/pdf/1704.00784.pdf

No21 混合注意力机制论文:

这个注意力很强大,比一般的注意力专注的地方更多,信息更丰富。我已经注意你很久了!呵呵呵~~~

因为混合注意力中含有位置信息,所以它可以在输入序列中选择下一个编码的位置。这样的机制更适用于输出序列大于输入序列的Seq2Seq任务,例如语音合成任务。

具体可以参考以下论文:

https://arxiv.org/pdf/1506.07503.pdf

五、高级的卷积网络知识

No22 胶囊网络与动态路由的论文:

这是一股为图像分类降温的寒风,深刻而又尖锐的点出了卷积网络的硬伤!从事最大池化再无翻身之日。

虽然胶囊网络在实际应用中,不像它的理论那么牛,但是对AI的帮助,卷积的理解是革命性的,非常值得一读。另外,这也是一篇绝对让你对数学彻底绝望的论文。花几根白头发把里面的算法啃下来吧,这样你与大神就能更近一步。

胶囊网络分为主胶囊与数字胶囊,主胶囊与数字胶囊之间的耦合系数是通过训练得来的。在训练过程中,耦合系数的更新不是通过反向梯度传播实现的,而是采用动态路由选择算法完成的。该算法来自以下论文链接:

https://arxiv.org/pdf/1710.09829.pdf

目前胶囊网络的研究还处于初级阶段,随着人们研究的深入,相信这些问题会得到解决。

No23 矩阵胶囊网络与EM路由算法:

如果你觉得不过瘾,那么还可以再看一篇。继续自虐一下。

带有EM(期望最大化)路由的矩阵胶囊网络是动态路由胶囊网络的一个改进版本。论文链接如下:

https://openreview.net/pdf?id=HJWLfGWRb

No24 胶囊网络的其它用处:

胶囊网络混身是宝,但就是自己不争气。这也说明还有上升的空间。就拿其中一个动态路由算法来讲,居然比普通的注意力还好。

看完之后,相信你一定会手痒!要不要也试试?把你的注意力换一下。值得你尝试,会有彩蛋的!

该论文的实践也证明,与原有的注意力机制相比,动态路由算法确实在精度上有所提升。具体介绍可见以下论文:

https://arxiv.org/pdf/1806.01501.pdf

No25 卷积网络新玩法TextCNN模型:

早先小编在一个项目中,自己用卷积网络处理字符数据。自己感觉很Happy。没想到,无意间居然发现了一篇同样这么干的论文。居然还有个名字,叫TextCNN。哎!可惜啊!小编文化少,只会写代码,不会写论文。

TextCNN模型是利用卷积神经网络对文本进行分类的算法,由 Yoon Kim 在 Convolutional Neural Networks for Sentence Classification 一文中提出。论文地址:

https://arxiv.org/pdf/1408.5882.pdf

六、图像内容处理部分

No26 FPN模型论文(包含了ROIAlign的匹配算法):

要是搞计算机视觉,还是要建议看一下。非常的基础。也是图像分割方面的用得最多得模型。

FPN的原理是:将骨干网络最终特征层和中间特征层的多个尺度的特征以类似金字塔的形式融合在一起。最终的特征可以兼顾两个特点——指向收敛目标的特征准确、特征语义信息丰富。更多信息可以参考论文:

ROIAlign层中的匹配算法也来自于这篇FPN论文,链接如下:

https://arxiv.org/abs/1612.03144

No27 Mask R-CNN模型论文:

效果好,代码多!硬货!来啃吧!

Mask R-CNN模型是一个简单、灵活、通用的对象实例分割框架。它能够有效地检测图像中的对象,并为每个实例生成高质量的分割掩码,还可以通过增加不同的分支完成不同的任务。它可以完成目标分类、目标检测、语义分割、实例分割、人体姿势识别等多种任务。具体细节可以参考以下论文:

https://arxiv.org/abs/1703.06870

No28 YOLO V3模型论文:

这个模型的提点就是快!目标识别强烈推荐。

YOLO V3模型的更多信息可以参考以下链接中的论文:

https://pjreddie.com/media/files/papers/YOLOv3.pdf

No29 Anchor-Fress模型--FCOS模型论文:

随着AI技术的进步Anchor-Fress模型死灰复燃(早先是YOLO V1那一批模型),这次不一样的是彻底干掉带Anchor的模型。训练起来那就一个爽!妈妈再也不用为我准备单独的Anchor标签了。

与YOLO V1相比, FCOS模型的思想与YOLO V1模型非常相似,唯一不同的是FCOS模型没有像YOLOv1那样只考虑中心附近的点,而是利用了ground truth边框中所有的点来进行预测边框。并且通过 center-ness 分支来抑制那些效果不行的检测边框。这样FCOS 就可以改善YOLO V1模型总会漏掉部分检测边框的缺点。

相关论文地址:

https://arxiv.org/abs/1904.01355

No30 Anchor-Fress模型--CornerNet-Lite模型论文:

一样也是Anchor-Fress模型,与FCOS效果差不多少,具体看一下论文吧。

CornerNet-Lite模型。相关论文地址:

https://arxiv.org/pdf/1904.08900.pdf

No31 栈式沙漏网络模型--Hourglass论文:

最初用户人的姿态估计,在符合模型中也是常被使用的模型。论文地址:

https://arxiv.org/abs/1603.06937

No32 OCR必修课——STN模型论文:

可以让模型自动仿射变化,你说牛不牛!要学OCR,就得从这个开始。

有关STN模型的论文链接如下:

https://arxiv.org/abs/1506.02025

七、循环神经网络部分

No33 QRNN模型论文:

在RNN模型的cell里,如果还只知道LSTM和GRU。那就太low了。快来补补吧:

如果想更多了解QRNN,可以参考以下论文:

https://arxiv.org/abs/1611.01576

No34 SRU模型论文:

接着来,各种RNN的Cell。又漂亮,又好吃!

SRU单元在本质上与QRNN单元很像。从网络构建上看,SRU单元有点像QRNN单元中的一个特例,但是又比QRNN单元多了一个直连的设计。

若需要研究SRU单元更深层面的理论,可以参考如下论文:

https://arxiv.org/abs/1709.02755

No35 IndRNN模型论文:

再补一个,这可都是好cell啊!

将IndRNN单元配合ReLu等非饱和激活函数一起使用,会使模型表现出更好的鲁棒性。

有关IndRNN单元的更多理论,可以参考论文:

https://arxiv.org/abs/1803.04831

No36 IndRNN模型论文:

最后,再来一个cell,如想要了解更多关于JANET单元的内容,可以参考以下论文:

https://arxiv.org/abs/1804.04849

八、AI合成部分

No37-38 Tacotron与Tacotron-2模型论文:

AI合成部分的经典模型,以上结构来自Tacotron与Tacotron-2两个结构,更多内容可以参考以下两篇论文:

https://arxiv.org/pdf/1703.10135.pdf

https://arxiv.org/pdf/1712.05884.pdf

No39 DeblurGAN模型论文:

图片合成的论文太多了。这里简单列几个,大体原理和思路了解即可。

DeblurGAN模型是一个对抗神经网络模型,由生成器模型和判别器模型组成。

—生成器模型,根据输入的模糊图片模拟生成清晰的图片。

—判别器模型,用在训练过程中,帮助生成器模型达到更好的效果。

具体可以参考论文:

https://arxiv.org/pdf/1711.07064.pdf

No40 AttGAN模型论文:

同样,这也是个图片合成的。不同的是多属性合成,相对比较有意思。

AttGAN模型由两个子模型组成:

(1)利用编码器模型将图片特征提取出来。

(2)将提取的特征与指定的属性值参数一起输入编码器模型中,合成出最终的人脸图片。

更多细节可以参考论文:

https://arxiv.org/pdf/1711.10678.pdf

No41 RNN.WGAN模型论文:

可以合成文本的GAN。离散数据也能干!

RNN.WGAN模型使用了WGAN模型的方法进行训练。详细做法可以参考如下论文:

https://arxiv.org/abs/1704.00028

九、多任务学习

No42 MKR模型论文:

多任务学习模型有必要了解一下。这里推荐一个论文给你看看。

MKR是一个多任务学习的端到端框架。该框架能够将两个不同任务的低层特征抽取出来,并融合在一起实现联合训练,从而达到最优的结果。有关MKR的更多介绍可以参考以下链接:

https://arxiv.org/pdf/1901.08907.pdf

十、NLP部分

No43 BERT模型论文:

如果你搞NLP,那么这个就不用我来介绍了。如果你准备搞NLP,那么赶紧来看看这个,跟上时代。

BERT相关论文链接

https://arxiv.org/abs/1810.04805

在BERT之后,又出了好多优秀的模型。但是,还是先把这个啃下来,再看别的才不费劲。

十一、模型攻防

No44 FGSM模型论文:

攻击模型的经典方法。值得掌握。

FGSM(Fast Gradient Sign Method)是一种生成对抗样本的方法。该方法的描述如下:

(1)将输入图片当作训练的参数,使其在训练过程中可以被调整。

(2)在训练时,通过损失函数诱导模型对图片生成错误的分类。

(3)当多次迭代导致模型收敛后,训练出来的图片就是所要得到的对抗样本。

具体可以参考论文:

https://arxiv.org/pdf/1607.02533.pdf

No45 黑箱攻击论文:

基于雅可比(Jacobian)矩阵的数据增强方法,是一种常用的黑箱攻击方法。该方法可以快速构建出近似于被攻击模型的决策边界,从而使用最少量的输入样本。即:构建出代替模型,并进行后续的攻击操作。

详细请见如下链接:

https://arxiv.org/abs/1602.02697

这里只是列了一些基础的论文。如果这45篇论文看完,可以保证你再看到大厂的产品时,不会感觉有代沟。

(*本文为 AI科技大本营转载文章,转载请联系原作者)

推荐阅读

追溯XLNet的前世今生:从Transformer到XLNet

Fast.ai:从零开始学深度学习 | 资源

基于GEMM实现的CNN底层算法被改?Google提出全新间接卷积算法

10个简单小窍门带你提高Python数据分析速度(附代码)

Python手写线性回归算法

程序员爬取 3 万条评论,《长安十二时辰》槽点大揭秘!

抖音微博等短视频千万级高可用、高并发架构如何设计?

为何 5G、物联网和区块链,可以成为科技铁三角?

相关文章:

深入理解JVM——虚拟机GC

对象是否存活 Java的GC基于可达性分析算法(Python用引用计数法),通过可达性分析来判定对象是否存活。这个算法的基本思想是通过一系列"GC Roots"的对象作为起始点,从这些节点开始向下搜索,搜索所走过的路径称为引用链,当…

2019年最新华为、BAT、美团、头条、滴滴面试题目及答案汇总

作者 | 苏克1900来源 | 高级农民工(ID:Mocun6)【导语】最近 GitHub 上一个库火了,总结了 阿里、腾讯、百度、美团、头条等国内主流大厂的技术面试题目,目前 Star 2000,还在持续更新中,预计会火下…

华胜天成ivcs云系统初体验2

重启完成以后,就看到传统的linux init3级别的登录界面。输入用户名root 密码:123456 (默认)接下来的工作是配置一些东西,让它跑起来。首先,要修改IP地址,还有机器名。输入命令:ivcs…

OpenCV中响应鼠标信息cvSetMouseCallback函数的使用

转自:http://blog.csdn.net/haihong84/article/details/6599838 程序代碼如下: #include <cv.h> #include <highgui.h> #include <stdio.h void onMouse(int event,int x,int y,int flags,void* param ); int main(int argc, char** …

日常遇到的一些问题或知识的笔记(一)

1、坑爹的sessionStorage 一直以为sessionStorage、localStorage跟cookie一样,只要存在,整个域名下都可见,直到新开了一个窗口tab页,惊奇的发现下面的sessionStorage丢失了! Web Storage 包含如下两种机制:…

你是“10倍工程师”吗?这个事,国外小伙伴们都快“吵”起来了

整理 | 夕颜出品 | AI科技大本营(ID:rgznai100)【导读】近日,推特上一个话题“10x工程师”异常火爆,引发的热议经久不散。这个话题由一位印度初创公司投资人 Shekhar Kirani 的一条推特引发,他写道;“如果…

运动目标跟踪__kalman

转自:http://blog.csdn.net/lindazhou2005/article/details/1534234 1、 什么是卡尔曼滤波器(What is the Kalman Filter?) 在学习卡尔曼滤波器之前,首先看看为什么叫“卡尔曼”。跟其他著名的理论(例如傅立叶变换&a…

Spring工厂常识

环境搭建导入Sring对应的jar包导入Spring依赖的commons-loggin包导入log4j.properties在src下导入ApplicationContext.xml在任意目录下是一个轻量级的企业开发框架核心:IOC , AOP编程IOC:也就是inverse of control 控制反转 就是讲创建对象的权利转移到工厂中,从而实现解耦合和…

iframe子页面操作父页面

2019独角兽企业重金招聘Python工程师标准>>> 最近经常用到iframe,用的最多的就是在子页面中操作父页面的方法或变量等,总结了用到的几种方法,如下: var tableName window.parent.frames["mainFrame"].tNam…

ASP.NET MVC动作过滤器

ASP.NET MVC中包含以下4种不同类型的Action Filter: 类型使用时机接口实现方法授权过滤器(Authorization Filter)在执行任何Filter或Action之前被执行,用于进行身份验证IAuthorizationFilterAuthorizeAttribute动作过滤器(Action Filter)在执行Action之前…

什么限制了GNN的能力?首篇探究GNN普适性与局限性的论文出炉!

作者 | Andreas Loukas译者 | 凯隐责编 | Jane出品 | AI科技大本营(ID: rgznai100)【导读】GNN是目前机器学习领域的热门网络之一,肯多研究与技术分享相比不可知的深度学习网络模型,GNN 有哪些吸引我们的优势及硬核实力。然而&…

OpenCV运动检测跟踪(blob track)框架组成模块详解

在..\opencv\doc\vidsurv文件夹中有三个doc文件,Blob_Tracking_Modules、Blob_Tracking_Tests、TestSeq,其中Blob_Tracking_Modules必须需要详读的。 “FG/BG Detection” module performsforeground/background segmentation for each pixel. “Blob E…

vi和软件安装

一 vi编辑器简介 vim 全屏幕纯文本编辑器 二 vim使用 1 vi 模式 vi 文件名 命令模式 输入模式 末行模式 命令----》输入 a:追加 i:插入 o:打开 i 命令----》末行 :w 保存 :q 不保存退出 2 命令模式操作 1)…

鸟哥学习笔记---网络安全基础

yum clean [packages|header|all] packages:将已下载的软件文件删除 headers:将下载的软件文件头删除 all:将所有容器数据都删除 添加镜像站点:mirrorlisthttp://ftp.twaren.net/Linux/CentOS/6/os/x86_64/ http://free.nchc.org.tw/drbl-core/i386/RPMS…

使用纯C++实现SQL Server2005 数据库读写操作详细步骤

环境:虚拟机windows xp,vs2008 SQLServer 2005 Express 数据库访问技术采用ADO。 需要安装的软件包括:microsoft_dotnetfxchs2.0.exe、WindowsInstaller-KB893803-v2-x86.exe、SQLEXPR32_CHS.EXE、SQLServer2005_SSMSEE.msi、SQLServer200…

硬核吃瓜!上万条数据撕开微博热搜真相

作者 | 徐麟来源 | 转载自数据森麟(ID:shujusenlin)吃瓜前言关于新浪微博,向来都是各路吃瓜群众聚集之地,大家在微博中可以尽情吃瓜,各种类型的瓜应有尽有,只有你想不到的,没有你吃不到的。微博…

python类的__slots__属性、__del__属性、上下文(__enter__和__exit__)、

常规情况下,类的属性字典是共享的,而实例的字典是独立的。如果一个类的属性较少,但是拥有很多的实例,这些实例的属性字典会占用较多的内存空间。对这样的类来说,为了节省内存空间,可以使用__slots__类变量代…

普通帧,关键帧,空白关键帧的区别

1. 特点 帧——是进行flash动画制作的最基本的单位,每一个精彩的flash动画都是由很多个精心雕琢的帧构成的,在时间轴上的每一帧都可以包含需要显示的所有内容,包括图形、声音、各种素材和其他多种对象。 关键帧——顾名思义,有关键…

Spark入门系列(二)| 1小时学会RDD编程

作者 | 梁云1991转载自Python与算法之美(ID:Python_Ai_Road)导读:本文为 Spark入门系列的第二篇文章,主要介绍 RDD 编程,实操性较强,感兴趣的同学可以动手实现一下。RDD 是弹性分布式数据集(Resilient Dist…

Office2010启动慢的解决方法

以word2010为例: 解决启动慢的问题: 转自:http://www.blue1000.com/bkhtml/2011-12/70698.htm 首先启动Word2010,-->单击进入“文件”选项卡-->选择左边的“选项”按钮-->弹出“word选项”对话框窗口,-->…

如何在 Vue 项目中使用 echarts

数据的重要性我们大家都知道,就算再小的项目中都可能使用几个图表展示,我最近在做项目的过程中也是需要用到图表,最后选择了echarts 图表库,为什么选择 echarts,第一:简单上手容易,第二…

OpenCV实现在图像中写入汉字

由于OpenCV自带的cvInitFont和cvPutText函数不支持向图像中写入中文,参考http://www.opencv.org.cn/forum/viewtopic.php?t2083 中的方法,在windows7 64位机上用vs2008OpenCV2.3.1实现具体步骤如下: 1、新建一个控制台工程Test,先…

Operations Manager 2012 SP1配置部署系列之(二) SCOM监控SCVMM

你可以使用Operations Mangager连接到VMM上去监控VMM管理的虚拟机和虚拟机的主机的健康和可用性.你还可以监视VMM管理服务器的健康和可用性,VMM数据库服务器、存储库服务器,和矢量调制法的自服务门户web服务器.当你把VMM与Operations Mangager集成、VMM的…

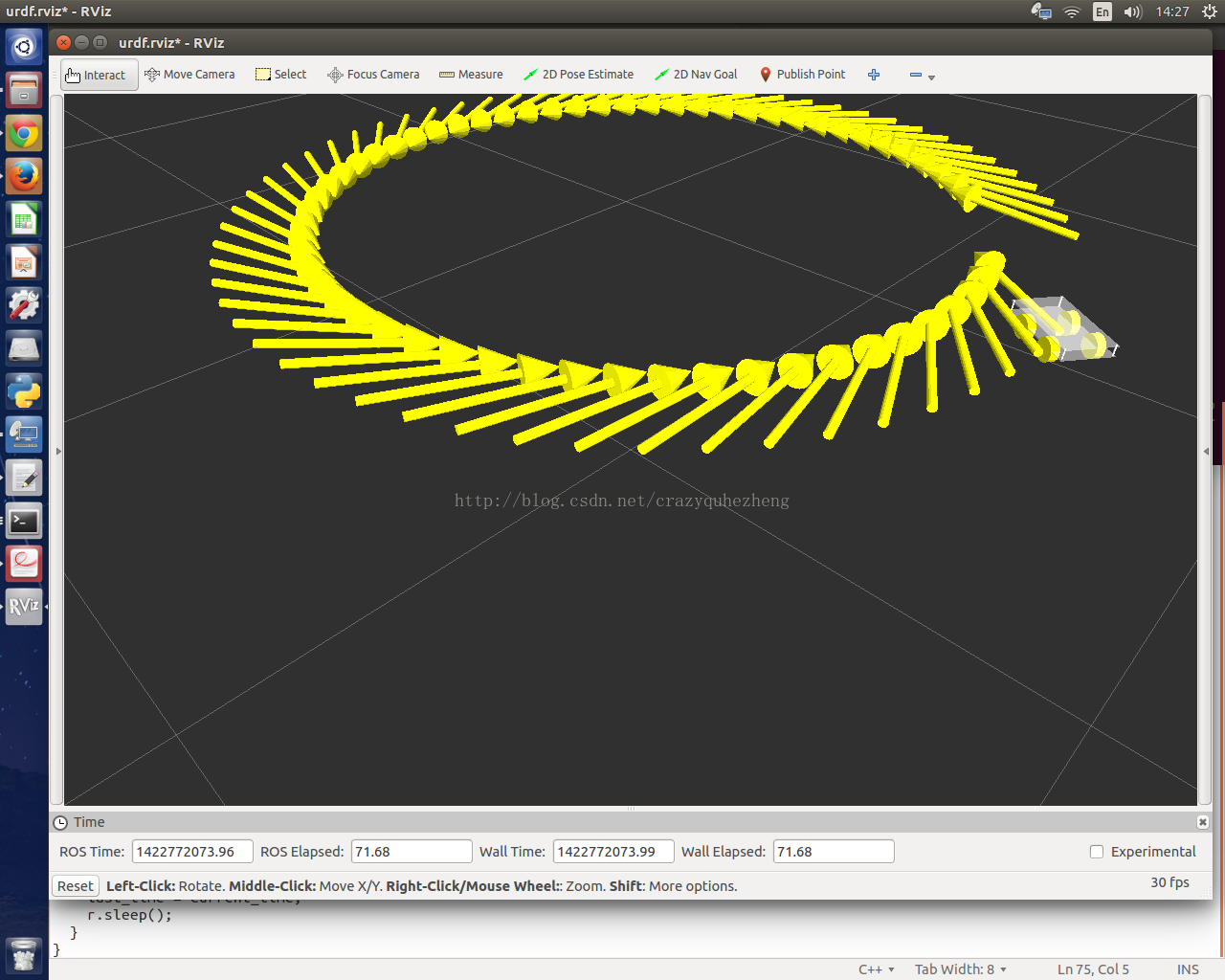

ROS中base_link, odom, fixed_frame, target_frame和虚拟大地图map的关系

前面已经介绍了如何使用URDF建造机器人小车并显示在Rviz的仿真环境里面,但是小车是静止的。下面介绍如何让它在Rviz里面动起来,并理清URDF,TF 和 odom 的关系。 1. ROS中base_link, odom, fixed_frame, target_frame和虚拟大地图map的关系 一般在urdf文件…

谷歌新研究:基于数据共享的神经网络快速训练方法

作者 | Google Brain译者 | 凯隐责编 | 夕颜出品 | AI科技大本营(ID:rgznai100)导读:神经网络技术的普及离不开硬件技术的发展,GPU 和 TPU 等硬件型训练加速器带来的高算力极大的缩短了训练模型需要的时间,使得研究者们…

制作一个简单的linux

我这里是借助宿主机做的一个简单的Linux,我们只要知道一个Linux启动过程需要什么,这里制作就简单的多了。不过没有基础的也没关系,我写的很详细,没有基础的看了我写的步骤只要细心也是会做出来的,我这里的小Linux是很简…

nginx是什么,如何使用

一:nginx是什么? 二:nginx作为网关,需要具备什么?(nginx可以作为web服务器,但更多的时候,我们把它作为网关,因为它具备网关必备的功能:) 反向代理…

OpenCV中Mat数据结构使用举例

#include "stdafx.h"#include <string>#include <iostream>#include <opencv2/opencv.hpp>using namespace std;using namespace cv;int _tmain(int argc, _TCHAR* argv[]){//创建一个用13j填充的 7 x 7 复矩阵-----1Mat M(7, 7, CV_32FC2, Scalar…

贾扬清加盟AI开发者大会!早鸟票抢购正式开启

整理 | 夕颜硬核 AI 技术大会,一年参加一次就够了。9 月 6日-7 日,2019 AI 开发者大会(AI ProCon)将在北京富力万丽酒店举行,人工领域技术领袖将再次齐聚一堂,探讨过去一年最新的 AI 技术趋势与变化&#x…

基本控件HyperlinkButton控件

HyperlinkButton控件可用来作为超链接按钮,支持页面导航。 若导航到MainPage.xaml,NavigateUri属性指定单击后导航页面的Uri 若导航到网页,必须同时指定TargetName,否则要报错。 <HyperlinkButton Width"200" Heigh…